Como instalar e usar o Ollama para executar modelos de linguagem grandes (LLMs) no seu computador Windows 11

Existem várias maneiras de executar grandes modelos de linguagem (LLMs) localmente na sua máquina Windows, e o Ollama é um dos mais simples e eficientes.

A interação mais comum que a maioria de nós tem com a IA agora é por meio de ferramentas baseadas em nuvem, como ChatGPT أو CopilotEssas ferramentas exigem uma conexão com a internet para serem usadas, mas a desvantagem é que elas podem ser usadas em quase qualquer dispositivo.

Mas nem todos querem depender da nuvem para aplicações de IA, especialmente desenvolvedores. Portanto, você quer que seu modelo de linguagem de grande porte (LLM) seja executado localmente na sua máquina. É aí que o Ollama entra.

Ollama é uma ferramenta de inferência que permite executar uma ampla gama de modelos de linguagem de grande porte (LLMs) nativamente no seu computador. Não é a única maneira de fazer isso, mas é uma das mais simples e diretas. Ollama permite que você aproveite o poder da IA sem precisar de uma conexão constante com a internet, dando a você controle total sobre seus dados e privacidade.

Depois de começar a usar, há muito o que fazer com o Ollama e os grandes modelos de linguagem (LLMs) que ele utiliza, mas o primeiro passo é a configuração. Vamos guiá-lo por esse processo passo a passo para que você possa aproveitar ao máximo esta ferramenta poderosa.

Requisitos do sistema Ollama

Executar o Ollama em si não consome muitos recursos do sistema e pode ser executado em uma ampla gama de dispositivos. É compatível com Windows 11, macOS e Linux. Você pode até mesmo usá-lo em suas distribuições Linux dentro do Windows 11 via WSL.

Mas a execução de modelos de linguagem de grande porte (LLMs) exige hardware mais potente. Quanto maior o modelo, maior o poder de processamento necessário. Esses modelos exigem uma unidade de processamento gráfico (GPU) para serem executados. Atualmente, eles não são otimizados para a unidade de processamento neural (NPU) dos novos PCs Copilot+.

Felizmente, existem modelos pequenos que você pode usar em hardware modesto. Por exemplo, o modelo Gemma 3 do Google tem um modelo de 1 bilhão de parâmetros que requer apenas 2.3 GB de memória visual de acesso aleatório (VRAM) para executar o modelo completo. Esse número aumenta para mais de 9 GB de VRAM se você migrar para o modelo de 4 bilhões de parâmetros.

O mesmo ocorre com o Llama 3.2 da Meta, onde o modelo de 1 bilhão de parâmetros requer uma GPU com apenas 4 GB de VRAM para funcionar corretamente. Esse número aumenta para 8 GB no modelo de 3 bilhões de parâmetros.

Resumindo, se você tem um computador relativamente moderno com pelo menos 8 GB de RAM e uma GPU dedicada, você poderá obter algum benefício usando o Ollama.

Guia de instalação do Ollama no Windows 11

Instalar o Ollama no Windows 11 é um processo muito fácil, que se resume em baixar Instale o programa do site oficial Ou de Repositório GitHube instale-o no seu dispositivo.

Estes são os passos simples.

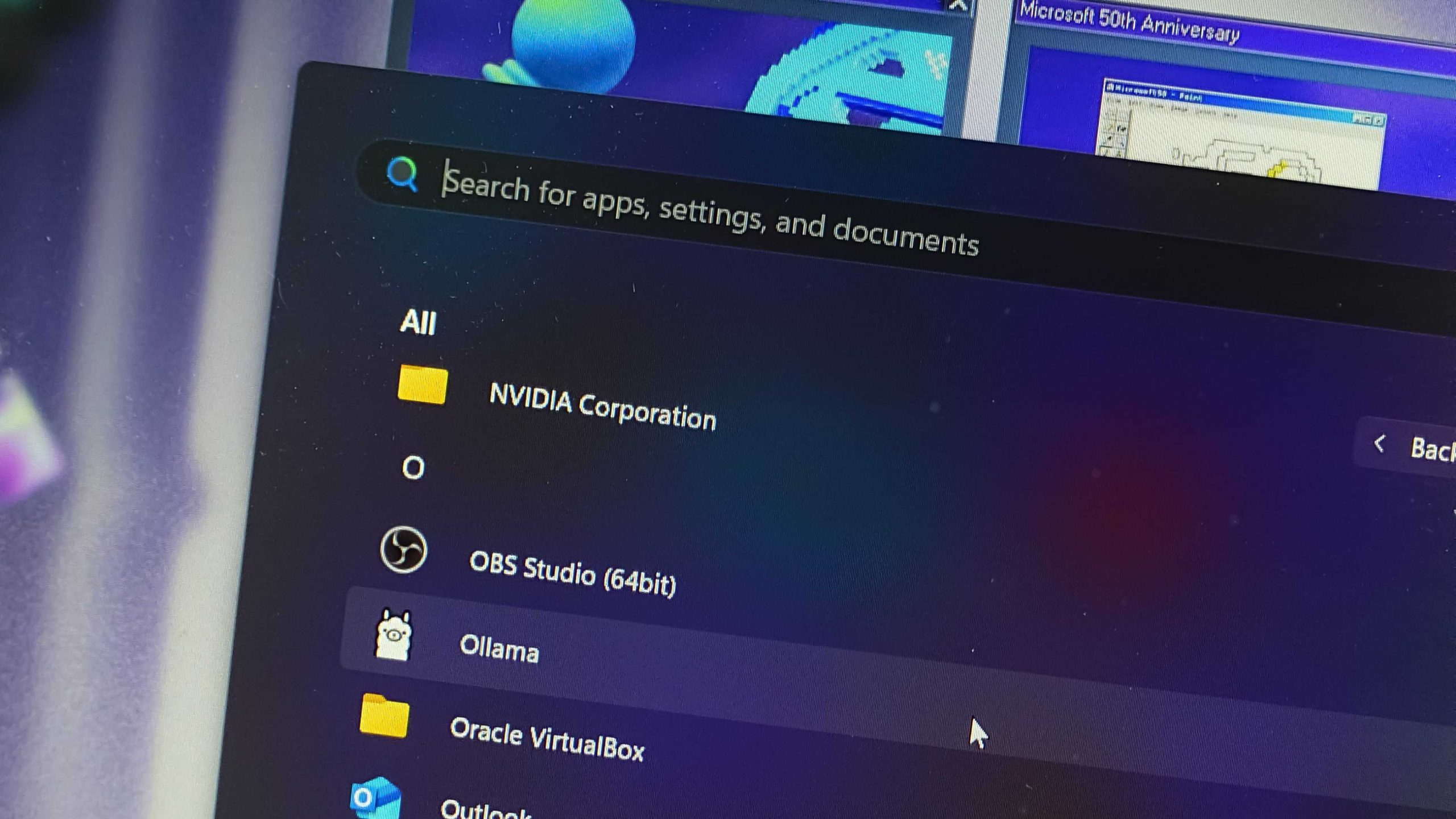

Após a instalação e o lançamento, nada aparecerá na sua área de trabalho. O programa roda inteiramente em segundo plano, mas você pode ver seu ícone na barra de tarefas.

Para verificar se o programa está funcionando corretamente, você pode acessar o endereço localhost: 11434 Em seu navegador.

Instale e execute seu primeiro modelo de linguagem grande (LLM) no Ollama

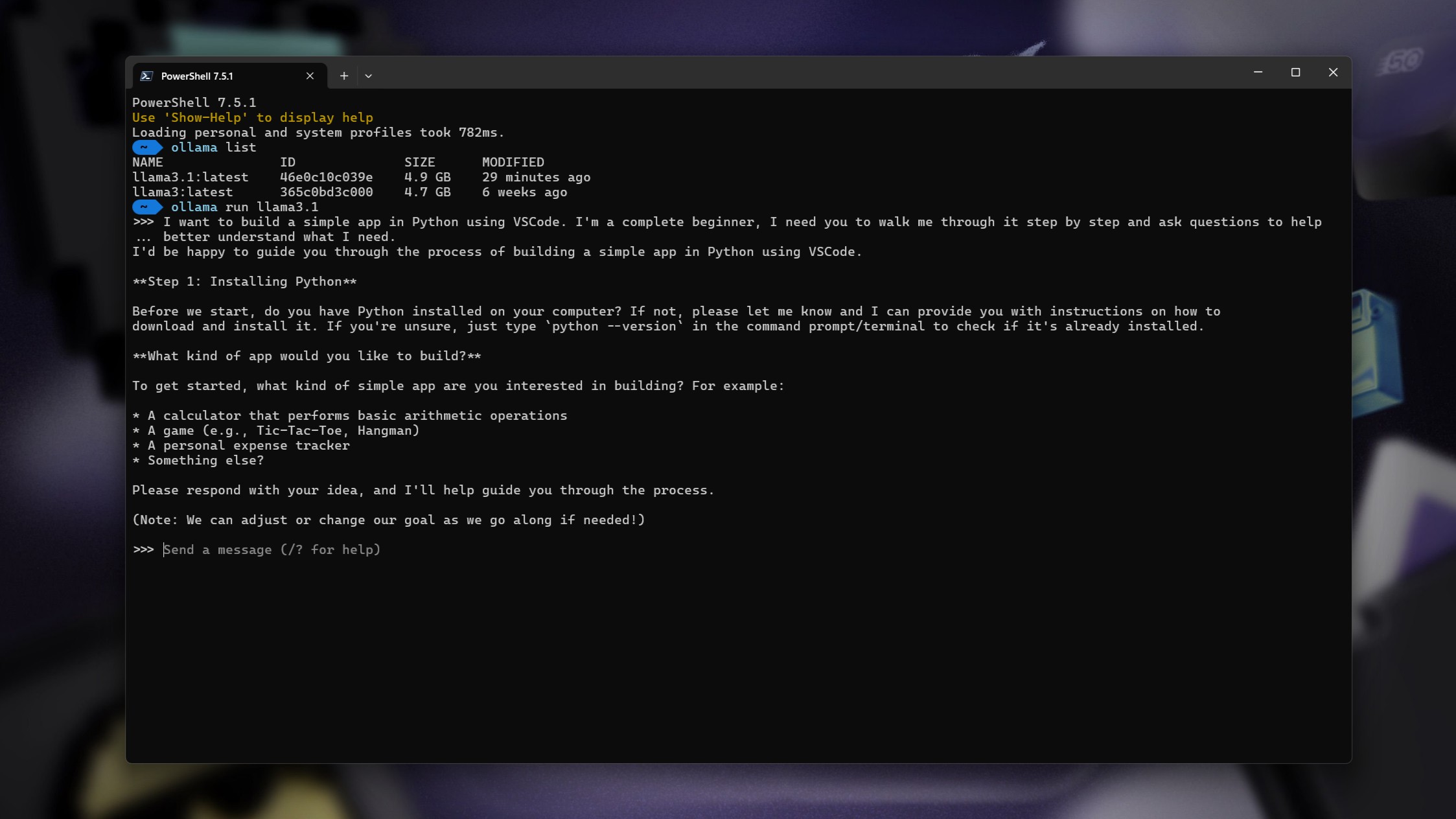

Para executar seu primeiro modelo de linguagem grande (LLM) usando o Ollama, você precisará usar principalmente a interface de linha de comando (CLI). Abra o PowerShell no Windows ou use o WSL se tiver o Ollama instalado.

Embora existam interfaces gráficas de usuário (GUIs) para o Ollama, focamos aqui no uso da linha de comando. É útil se você se sentir confortável usando a CLI.

As duas coisas principais que você precisa saber são:

correr

coloque isso

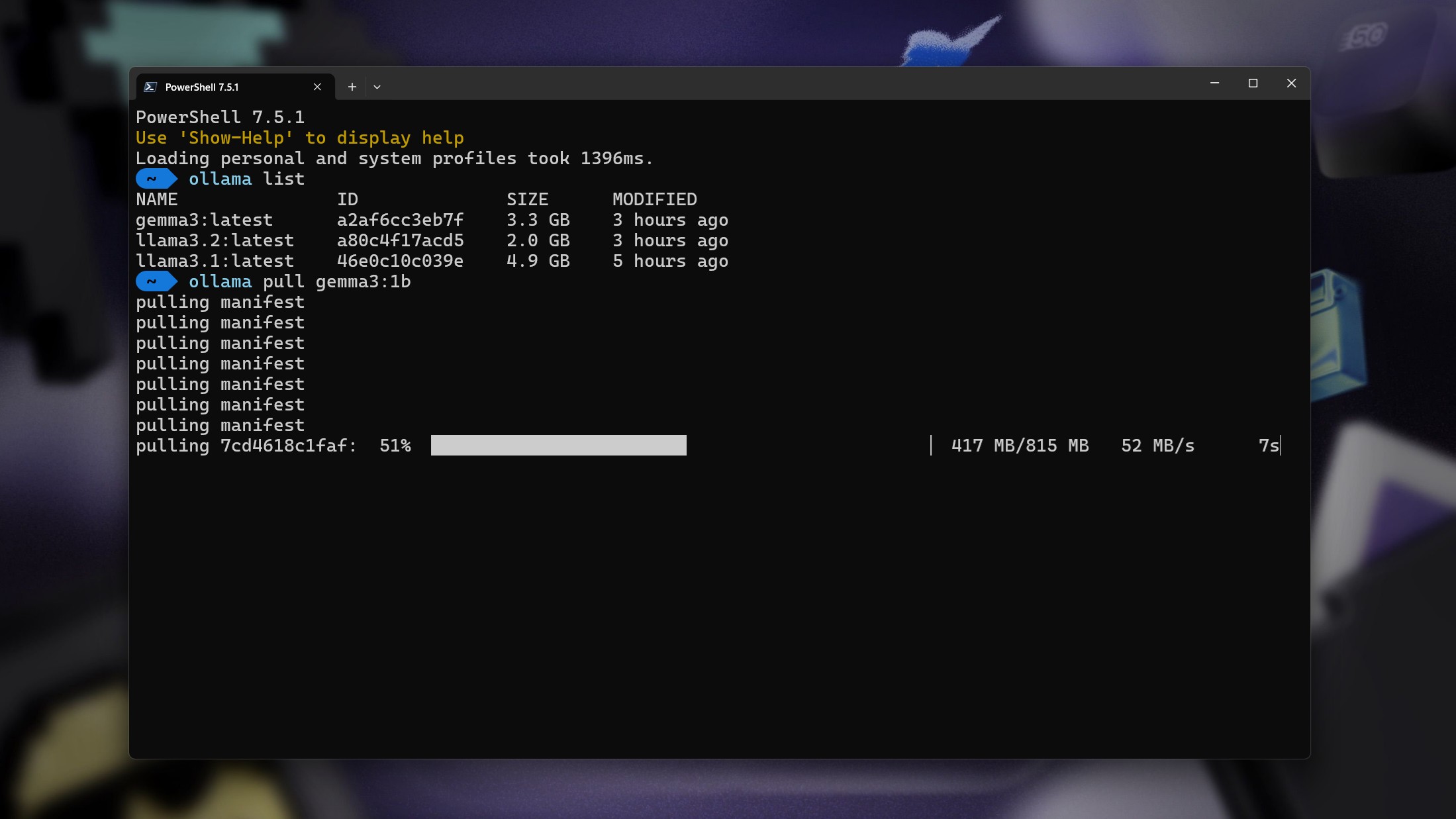

Se você solicitar ao Ollama para executar um modelo LLM que não esteja instalado no momento, ele o baixará automaticamente primeiro e, em seguida, o executará. Você pode encontrar facilmente os nomes corretos para os modelos de linguagem grandes que deseja instalar em Site Ollama.

Por exemplo, para instalar e executar o modelo Google Gemma 3 LLM de 1 bilhão de parâmetros, digite o seguinte comando:

ollama corre Gemma:1b

Observe que adicionar :1b Após o nome, especifique que você deseja o modelo de 1 bilhão de parâmetros. Se desejar o modelo de 4 bilhões de parâmetros, altere-o para **:4b**.

Executar formulários no seu terminal abrirá uma experiência familiar de chatbot, permitindo que você escreva seus prompts e receba respostas, tudo isso executado localmente no seu dispositivo.

Para sair do formulário e retornar ao PowerShell, basta digitar **/bye** e o processo será encerrado.

Este artigo aborda os princípios básicos da configuração do Ollama no seu computador para usar o conjunto de LLMs disponíveis. A experiência básica é muito simples e fácil de usar, exigindo praticamente nenhum conhecimento técnico para a configuração. Se eu consegui, você também consegue!

Comentários estão fechados.