Os riscos da IA empresarial: alternativas ao OpenAI e as instituições por trás dos agentes de IA

Privacidade de dados, conformidade e lacunas de confiança nas integrações atuais de agentes de IA

“Espere… você está enviando suas entradas de razão para o OpenAI?”

Essa foi a primeira coisa que minha amiga me perguntou quando mostrei a ela. Sinta-Escreva, um aplicativo de registro no diário com tecnologia de IA que criei durante um hackathon em São Francisco.

Dei de ombros.

“Era um hackathon com tema de IA, e eu precisava construir algo rapidamente.”

Ela não perdeu um momento:

"Claro. Mas como posso confiar no que construí? Por que não organizar seu próprio mestrado?"

Isso me fez parar.

Fiquei orgulhoso da rapidez com que o aplicativo foi criado. Mas essa pergunta, e as que se seguiram, revelaram tudo o que eu achava que sabia sobre construir de forma responsável com IA. Os jurados do hackathon também mencionaram isso.

Aquele momento me fez perceber o quão desrespeitosos somos ao construir com IA, especialmente com ferramentas que lidam com dados confidenciais.

Percebi algo maior:

Não falamos o suficiente sobre confiança ao construir com IA.

A resposta dela ficou na minha cabeça. Georgia von Minden é cientista de dados na ACLU, onde trabalha em estreita colaboração com questões relacionadas a informações de identificação pessoal em contextos legais e de direitos civis. Sempre apreciei a percepção dela, mas essa conversa foi diferente.

Então pedi que ela explicasse. O que confiança realmente significa neste contexto? Especialmente quando os sistemas de IA lidam com dados pessoais.

Ela me disse:

“A confiança pode ser difícil de estabelecer, mas a governança de dados é um bom ponto de partida. Quem é o proprietário dos dados, como eles são armazenados e para que são usados são questões importantes. Dez anos atrás, eu teria respondido a essa pergunta de forma diferente. Mas hoje, com enorme poder computacional e vastos estoques de dados, a inferência ampla é uma preocupação real. A OpenAI tem acesso tão amplo à computação e aos dados que sua falta de transparência justifica cautela.”

Quando se trata de informações de identificação pessoal (PII), tanto as regulamentações quanto o bom senso apontam para a necessidade de uma governança de dados robusta. Enviar informações de identificação pessoal em chamadas de API não é apenas arriscado, mas também pode violar essas regras e colocar indivíduos em risco.

Isso me lembrou que quando construímos com IA, especialmente sistemas que lidam com dados humanos sensíveis, não estamos apenas escrevendo código.

Tomamos decisões sobre privacidade, autoridade e confiança.

No momento em que você coleta dados do usuário, especialmente algo pessoal, como entradas de diário, você assume um espaço de responsabilidade. Não se trata apenas do que seu modelo pode fazer. O importante é o que acontece com esses dados, para onde eles vão e quem tem acesso a eles. O gerenciamento responsável dos dados do usuário aumenta a confiança do usuário e melhora a privacidade.

A ilusão da simplicidade

Hoje em dia é mais fácil do que nunca lançar algo que pareça inteligente. Com grandes modelos de linguagem (LLMs) como OpenAI e outros, os desenvolvedores podem criar ferramentas de IA em questão de horas. Startups podem lançar recursos “alimentados por IA” da noite para o dia. E as instituições? Ela está com pressa para integrar esses agentes ao seu fluxo de trabalho.

Mas em meio a toda essa excitação, uma coisa muitas vezes passa despercebida: Confiança.

Quando as pessoas falam sobre Agentes de IAEles geralmente se referem a wrappers simples em torno de grandes modelos de linguagem (LLMs). Esses agentes podem responder perguntas, automatizar tarefas ou até mesmo tomar decisões. Mas muitos são construídos às pressas, com pouca atenção à segurança, conformidade ou responsabilidade.

Basta usar o produto para OpenAI Não significa que seja seguro. O que você realmente confia é em todo o pipeline:

- Quem construiu a capa?

- Como seus dados são tratados?

- Suas informações estão sendo armazenadas, registradas ou, pior, vazadas?

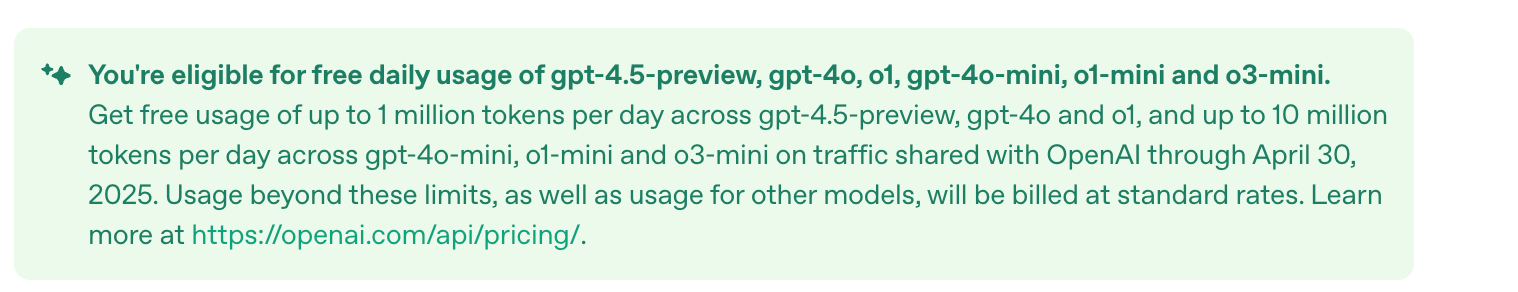

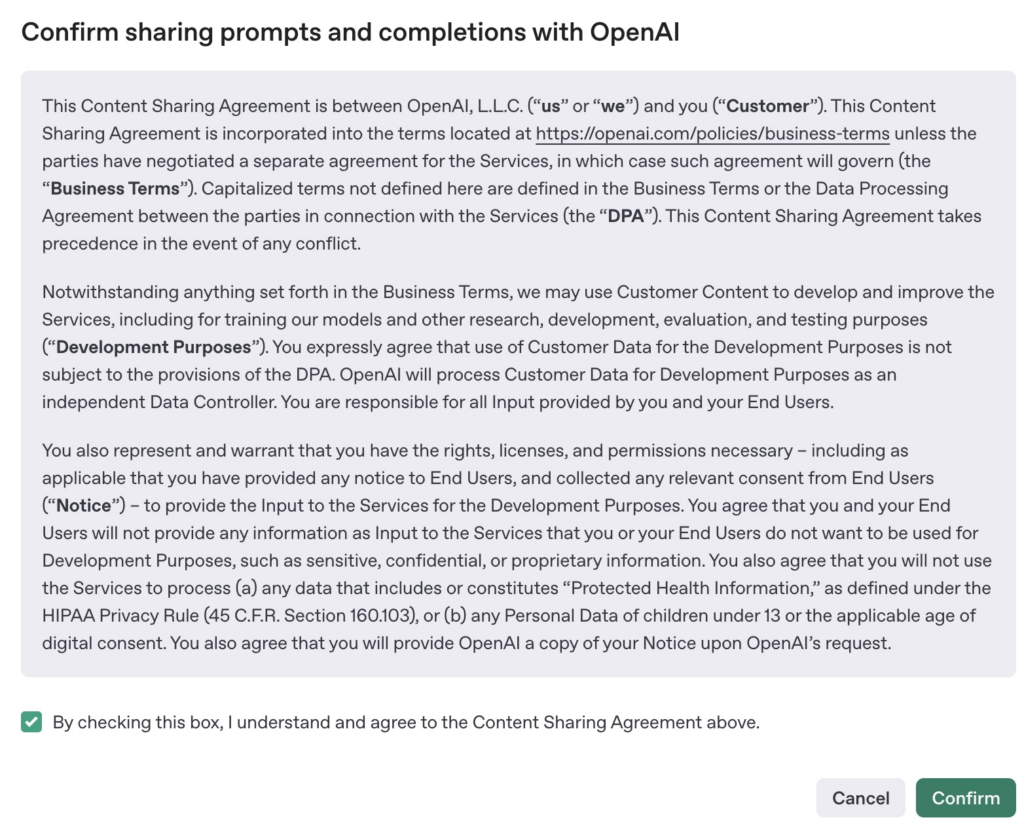

Eu mesmo tenho usado a API da OpenAI para casos de uso de clientes. Recentemente, me ofereceram acesso gratuito à API – até 1 milhão de tokens por dia até o final de abril – Se eu concordar em compartilhar meus dados de reivindicações.

Quase concordei com isso para um projeto pessoal, mas então me ocorreu: se um provedor de soluções fizesse o mesmo acordo para cortar custos, seus usuários não teriam ideia de que seus dados estavam sendo compartilhados. Em um nível pessoal, isso pode parecer inofensivo. Mas no contexto da instituição? Isto é uma violação grave de privacidade e possivelmente de obrigações contratuais ou regulatórias.

Basta que um engenheiro diga "sim" a um acordo como esse, e os dados do seu cliente estarão nas mãos de outra pessoa.

IA empresarial aumenta expectativas

Vejo cada vez mais empresas de SaaS e startups de ferramentas de desenvolvimento experimentando agentes de IA. Alguns estão apresentando bons resultados, com alguns agentes de IA permitindo que os usuários tragam seus próprios modelos de linguagem de grande porte (LLMs), dando-lhes controle sobre onde o modelo é executado e como os dados são processados. Essa é uma abordagem sensata, especialmente porque a IA se torna cada vez mais importante nas empresas.

Esta é a abordagem ponderada: Você define os limites de confiança..

Mas nem todo mundo está tão entusiasmado.

Muitas empresas simplesmente se conectam à API da OpenAI, adicionam alguns botões e dizem que ela está "pronta para uso corporativo".

Aviso: Isso não é verdade.

O que poderia dar errado? bastante.

Se você integrar agentes de IA à sua infraestrutura sem fazer perguntas difíceis, aqui estão os riscos potenciais:

- Vazamento de dadosSuas reivindicações podem incluir dados confidenciais do cliente, chaves de API ou lógica interna e, se enviadas a um formulário de terceiros, elas podem ser expostas.

Em 2023, engenheiros da Samsung inadvertidamente colaram código-fonte interno e notas no ChatGPT (Forbes). Esses dados agora podem fazer parte de futuros conjuntos de treinamento – um risco significativo de propriedade intelectual.

- Violações de conformidadeEnviar informações de identificação pessoal (PII) por meio de um formulário como o OpenAI sem os controles apropriados pode violar o Regulamento Geral de Proteção de Dados (GDPR), o HIPAA ou seus contratos.

A empresa X de Elon Musk aprendeu isso da maneira mais difícil. Eles lançaram seu chatbot de IA, “Grok”, usando todas as postagens de usuários, incluindo usuários da UE, para treiná-lo, sem a devida assinatura. Os organizadores intervieram rapidamente. Sob pressão, eles pararam de treinar Grok na União Europeia (Politico).

- comportamento vagoAgentes não determinísticos são difíceis de corrigir ou explicar. O que acontece quando um cliente pergunta por que um chatbot fez uma recomendação errada ou revelou algo confidencial? Você precisa de transparência para responder a isso – e muitos agentes hoje não a fornecem.

- Confusão sobre propriedade de dadosQuem é o dono do produto? Quem registra os dados? O provedor de serviços realiza retreinamento com base em suas informações?

O Zoom foi pego fazendo exatamente isso em 2023. Eles mudaram discretamente seus termos de serviço para permitir o uso de dados de reuniões com clientes para treinar IA (Fast Company). Após uma reação pública, eles reverteram a política, mas isso serviu como um lembrete de que a confiança pode ser perdida da noite para o dia.

- Falhas de segurança na embalagemEm 2024, dezenas de implantações do Flowise – uma ferramenta popular de orquestração LLM de baixo código – foram encontradas expostas à Internet, muitas sem autenticação (Notícias de cibersegurança). Pesquisadores descobriram chaves de API, credenciais de banco de dados e dados de usuários publicamente. Este não é um problema da OpenAI - isto é um problema. Construtores. Mas os usuários finais ainda pagam o preço.

- Recursos de IA que vão longe demaisO recurso "Recall" da Microsoft – parte do lançamento do Copilot – capturou automaticamente capturas de tela da atividade dos usuários para ajudar o assistente de IA a responder a perguntas (Duplo Pulsar). Parecia útil... até que especialistas em segurança apontaram que era um pesadelo de privacidade. A Microsoft teve que voltar atrás rapidamente e tornar o recurso apenas opcional.

Nem tudo precisa do OpenAI.

OpenAI é uma plataforma incrivelmente poderosa. Mas nem sempre é a melhor solução.

Às vezes, um modelo local menor é suficiente. Outras vezes, a lógica baseada em regras funciona melhor. A opção mais segura geralmente é aquela que opera inteiramente dentro de sua própria infraestrutura, de acordo com suas regras.

Não deveríamos simplesmente conectar cegamente um grande modelo de linguagem (LLM) e chamá-lo de “assistente inteligente”.

Nas instituições, Confiança, transparência e controle não são opcionais. - Pelo contrário, é essencial.

Há um número crescente de plataformas que permitem esse tipo de controle. O Einstein 1 Studio da Salesforce agora oferece suporte ao recurso traga seu próprio modelo, permitindo que você conecte seu modelo de linguagem grande (LLM) da AWS ou do Azure. O IBM Watson permite que organizações implantem modelos internamente com trilhas de auditoria completas. Com o MosaicML, o Databricks permite que você treine modelos de linguagem grandes (LLMs) privados dentro da sua própria nuvem, para que seus dados confidenciais nunca saiam da sua infraestrutura.

É assim que a verdadeira IA empresarial deve ser.

Conclusão

Os agentes de IA são incrivelmente poderosos, permitindo fluxos de trabalho e automação que não conseguíamos alcançar antes. No entanto, facilidade de desenvolvimento não significa necessariamente segurança, especialmente quando se lida com dados confidenciais em grande escala.

Antes de começar a usar este novo agente brilhante, pergunte a si mesmo:

- Quem controla o modelo?

- Para onde vão os dados?

- Estamos em conformidade com as regulamentações?

- Podemos verificar o que ele está fazendo?

Na era da inteligência artificial, a maior ameaça não é a má tecnologia, mas Confiança cega.

Sobre o autor

Sou Ellen, engenheira de aprendizado de máquina com 6 anos de experiência e atualmente trabalho em uma startup de fintech em São Francisco. Minha experiência abrange funções de ciência de dados em consultoria de petróleo e gás, além de liderança de programas de treinamento em IA e dados na Ásia-Pacífico, Oriente Médio e Europa.

Atualmente, estou concluindo meu mestrado em Ciência de Dados (me formando em maio de 2025) e estou procurando ativamente minha próxima oportunidade como Engenheiro de Aprendizado de Máquina. Se você estiver aberto a uma indicação ou conexão, ficarei muito grato!

Adoro causar um impacto real no mundo por meio da IA e estou sempre aberto a colaborações baseadas em projetos também.

Comentários estão fechados.