Minha experiência pessoal: executando um chatbot de IA real localmente em um iPhone

Chatbots com tecnologia de IA, como: ChatGPT و Gemini...depender da computação em nuvem para funcionar. Mas e se você pudesse executar um modelo de linguagem de grande porte (LLM) diretamente no seu iPhone, sem precisar de assinatura, conexão com a internet ou mesmo que seus dados saíssem do dispositivo? Graças a um conjunto de aplicativos e modelos leves e compactos, isso já é possível.

Eu mesmo tentei, e aqui está o que você precisa saber.

Execute IA localmente no iPhone

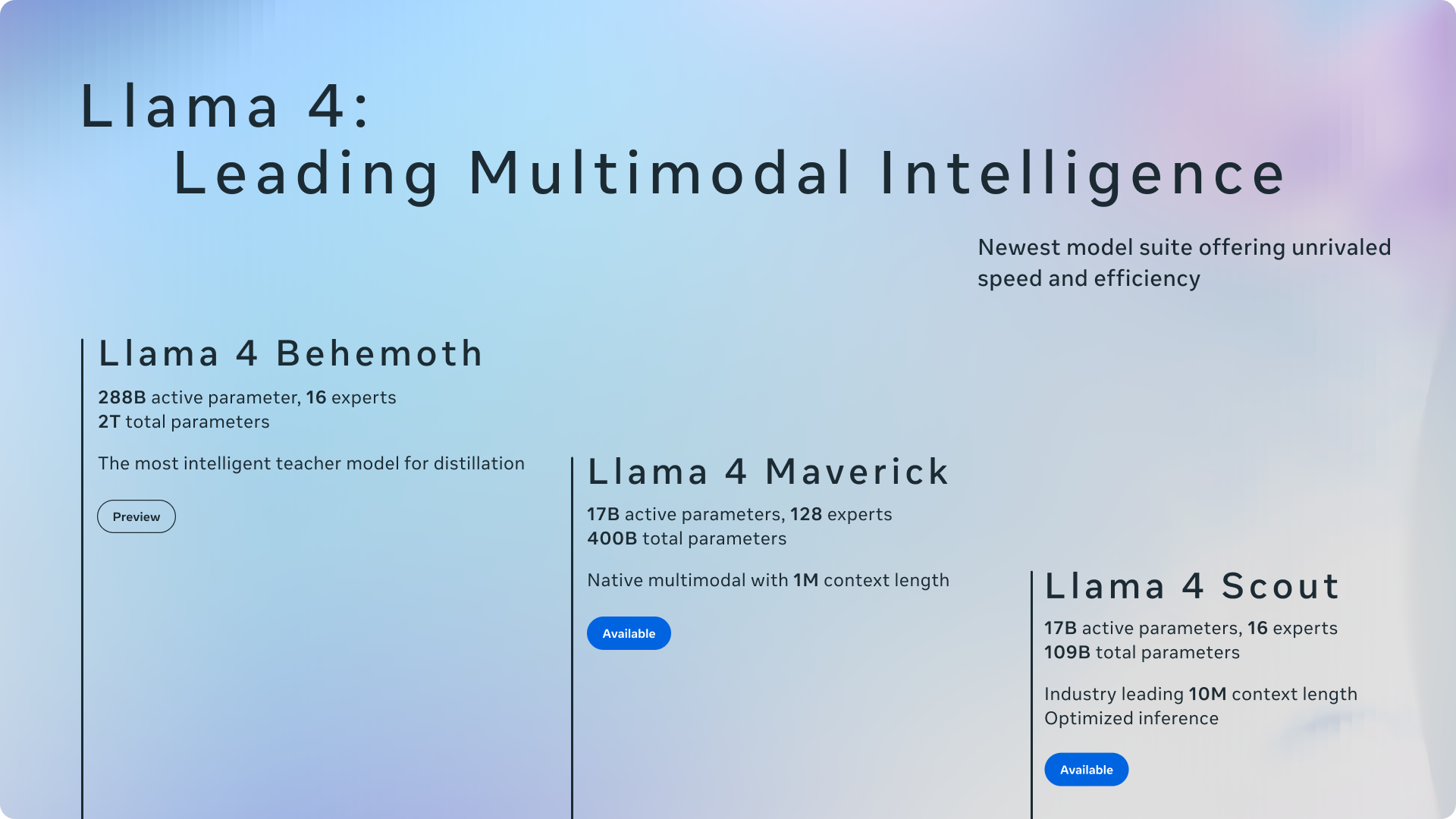

Agora você pode executar modelos de código aberto como lhama و Qwen Diretamente no iOS. Esses modelos são reduzidos usando um processo chamado quantização, que os compacta para caber na memória do dispositivo sem afetar significativamente o desempenho.

Mas há um ponto importante: o desempenho depende muito do seu dispositivo. Por exemplo, o iPhone 15 Pro ou 15 Pro Max, equipado com o chip mais recente da Apple, pode rodar modelos com até 7 ou 8 bilhões de parâmetros (como o Llama 3.1 8B), enquanto celulares mais antigos são mais adequados para modelos menores, com parâmetros entre 1 e 3 bilhões.

Aplicativos que tornam isso possível

- LLM Farm (grátis): A maneira mais fácil de começar. Você pode baixar um modelo pequeno (como o Phi-3.5 Instruct) e executá-lo offline com apenas um clique. É surpreendentemente tranquilo para consultas rápidas.

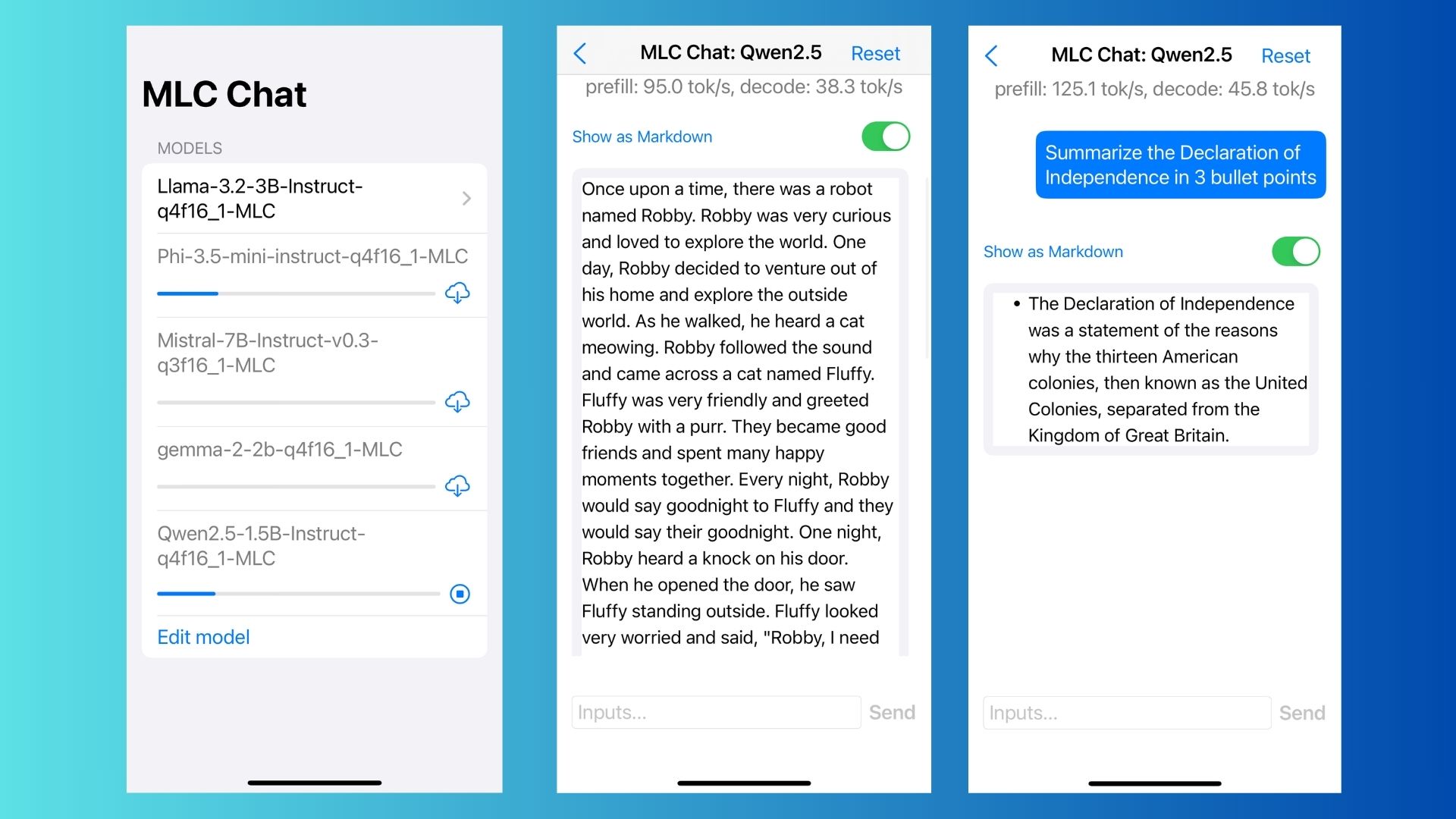

- Bate-papo MLC (grátis):

Este é o aplicativo que usei. Eu queria experimentar o LLM Farm, mas por algum motivo ele não estava disponível para download na App Store da Apple. Como é gratuito, testei e funcionou perfeitamente. - LLM Privado (Projeto Comunitário): Esta opção é mais um projeto "faça você mesmo" do que para o usuário comum. Este aplicativo inclui guias detalhados para baixar modelos como Llama 3.1 e Qwen para o seu iPhone. Se você gosta de mexer e experimentar, definitivamente vale a pena experimentar.

- Apollo (pago): Ouvi falar muito bem dele, mas ainda não experimentei. Deixe nos comentários o que você acha deste aplicativo focado em privacidade.

Como executar o modelo localmente

Após baixar o aplicativo escolhido, abra-o. A partir daí, navegue pela lista de modelos integrados e selecione um (por exemplo, Phi-3.5 Instruct Q4 quantizado). Escolhi o Qwen 2.5 pelo simples motivo de não o usar há algum tempo.

Após o download, você verá o formulário no seu dispositivo (o tamanho varia de algumas centenas de megabytes a vários gigabytes). A partir daí, basta começar a conversar.

Você precisa ser realista; este não é o momento de pedir análises aprofundadas ou planos longos e detalhados. Considere o seguinte:

- a velocidade: Modelos pequenos (1-3 bilhões de parâmetros) respondem mais rápido, enquanto modelos grandes podem levar segundos por símbolo.

- Contexto: Não cole artigos inteiros; mantenha os prompts mais curtos.

- Saída: Os modelos locais de grandes idiomas podem ser menos precisos que o ChatGPT, mas são úteis para anotações, resumos, perguntas e respostas e rascunhos leves.

Eu me diverti testando alguns dos prompts. Nada complicado; eu só queria ver que tipo de resposta eu recebia da solicitação local. Uma coisa que você notará imediatamente é a velocidade. É incrível a rapidez com que um modelo de linguagem grande responde.

Testei as seguintes alegações e, no geral, gostei dos resultados.

- Resuma a Declaração de Independência em três pontos.

- “Escreva uma pequena história para dormir sobre um robô e um gato.”

- “Dê-me três ideias de jantar com frango, arroz e brócolis.”

Executar um grande modelo de idioma local não é o mesmo que conversar com Bate-papoGPT-5Certamente parece simplista e rudimentar. Se você tentar isso, lembre-se de manter seus prompts curtos, pois as janelas de contexto são muito mais limitadas do que usando a versão normal do chatbot. Você sentirá que as respostas serão mais lentas se sobrecarregar o modelo de linguagem local.

Por que você faria isso?

- Não há taxas de assinatura. Você não precisa gastar todo seu crédito só para tentar.

- Privacidade integrada. Tudo fica no seu próprio dispositivo.

- Surpreendentemente versátil. Fiquei realmente impressionado com a quantidade de tarefas que a miniatura conseguia realizar. Sempre que testava seus limites, ela conseguia encarar o desafio com facilidade.

O resultado final

Se você tem um iPhone 15 ou posterior e quer explorar a aparência da IA “por dentro”, comece por aí. Pode ser Fazenda LLM أو Bate-papo MLCC Maneiras rápidas e gratuitas de começar. Se você se preocupa com privacidade, o aplicativo Apollo Vale a pena tentar. Se você é fã de experimentação e personalização, LLM privado Permite que você se aprofunde nas configurações personalizadas.

Lembre-se: estes não são os chatbots completos com os quais você está acostumado, então não espere resultados como os do ChatGPT. Mas é bem legal e futurista rodar sua própria IA no seu iPhone.

Comentários estão fechados.