O Google lança o Gemini 2.0 Pro e o Flash-Lite, conectando o Flash Thinking ao YouTube, Maps e Search

A série Gemini de grandes modelos de linguagem (LLMs) do Google teve um começo difícil há quase um ano, com algumas imagens embaraçosas geradas incorretamente, mas melhorou constantemente desde então, e a empresa parece determinada a fazer de seu esforço de segunda geração — Gemini 2.0 — o maior e melhor até agora para consumidores e empresas.

اليوم ، Ela anunciou A empresa anunciou o lançamento público do Gemini 2.0 Flash, apresentou o Gemini 2.0 Flash-Lite e lançou uma versão beta do Gemini 2.0 Pro.

Esses modelos, projetados para dar suporte a desenvolvedores e empresas, agora estão disponíveis no Google AI Studio e no Vertex AI, com o Flash-Lite disponível em versão prévia pública e o Pro disponível para testes iniciais.

“Todos esses modelos contarão com entrada multimídia com saída de texto no lançamento, com a mídia Plus disponível para uso geral nos próximos meses”, escreveu o CTO do Google DeepMind, Koray Cavukcioglu, na postagem do blog da empresa anunciando o anúncio — mostrando uma vantagem que o Google está trazendo para a mesa, mesmo com concorrentes como DeepSeek و OpenAI No lançamento de concorrentes fortes.

O Google aproveita seus recursos multimídia

Nem o DeepSeek-R1 nem Novo modelo o3-mini da OpenAI Aceitar entradas multimídia, ou seja, imagens, uploads de arquivos ou anexos.

Embora o modelo R1 possa aceitá-los em seu site e aplicativo de bate-papo móvel, ele usa reconhecimento óptico de caracteres (OCR), uma tecnologia com mais de 60 anos, para extrair apenas o texto desses uploads — e não entende nem analisa nenhum dos outros recursos neles.

No entanto, ambos representam uma nova classe de modelos de “pensamento” que deliberadamente levam mais tempo para pensar nas respostas e refletir sobre “cadeias de pensamento” e a validade de suas respostas. Isso contrasta com modelos típicos de grandes linguagens, como a série Gemini 2.0 Pro, então comparar o Gemini 2.0 com o DeepSeek-R1 e o OpenAI o3 é como comparar maçãs com laranjas.

Mas também houve algumas novidades no lado pensante do Google hoje: o CEO do Google, Sundar Pichai, anunciou via Plataforma X Sobre a atualização do aplicativo Google Gêmeos Para celulares iOS e Android com Gemini 2.0 Flash Thinking. O modelo pode ser conectado ao Google Maps, YouTube e Google Search, permitindo um conjunto totalmente novo de pesquisas e interações com tecnologia de IA que seus novos concorrentes sem esses serviços, como DeepSeek e OpenAI, não conseguem igualar.

Testei-o brevemente no aplicativo Google Gemini para iOS no meu iPhone enquanto escrevia este artigo, e ele foi impressionante, com base em minhas pesquisas iniciais, encontrando semelhanças entre os 10 vídeos mais assistidos do YouTube no mês passado e me fornecendo uma lista de consultórios médicos próximos e seus horários de funcionamento, tudo em segundos.

Lançamento público do Gemini 2.0 Flash

O modelo Gemini 2.0 Flash, lançado inicialmente como uma versão beta, tornou-se Em dezembro, pronto para produção agora.

Projetado para aplicações de IA altamente eficientes, ele fornece respostas de baixa latência e suporta raciocínio multimodal em larga escala.

Uma de suas principais vantagens sobre a concorrência é sua janela de contexto, ou o número de tokens que um usuário pode adicionar em um incentivo e receber de volta em uma única interação de ida e volta com um chatbot ou API com tecnologia LLM.

Embora muitos modelos líderes, como o novo o3-mini da OpenAI, lançado na semana passada, suportem 200000 tokens ou menos — o equivalente a um romance de 400 a 500 páginas — o Gemini 2.0 Flash suporta XNUMX milhão de tokens, o que significa que ele pode lidar com grandes quantidades de informações, tornando-o particularmente útil para tarefas de alta frequência e larga escala.

Gemini 2.0 Flash-Lite: Soluções de IA de baixo custo

Gemini 2.0 Flash-Lite é um novo modelo de linguagem de grande porte que visa fornecer soluções de IA econômicas sem comprometer a qualidade.

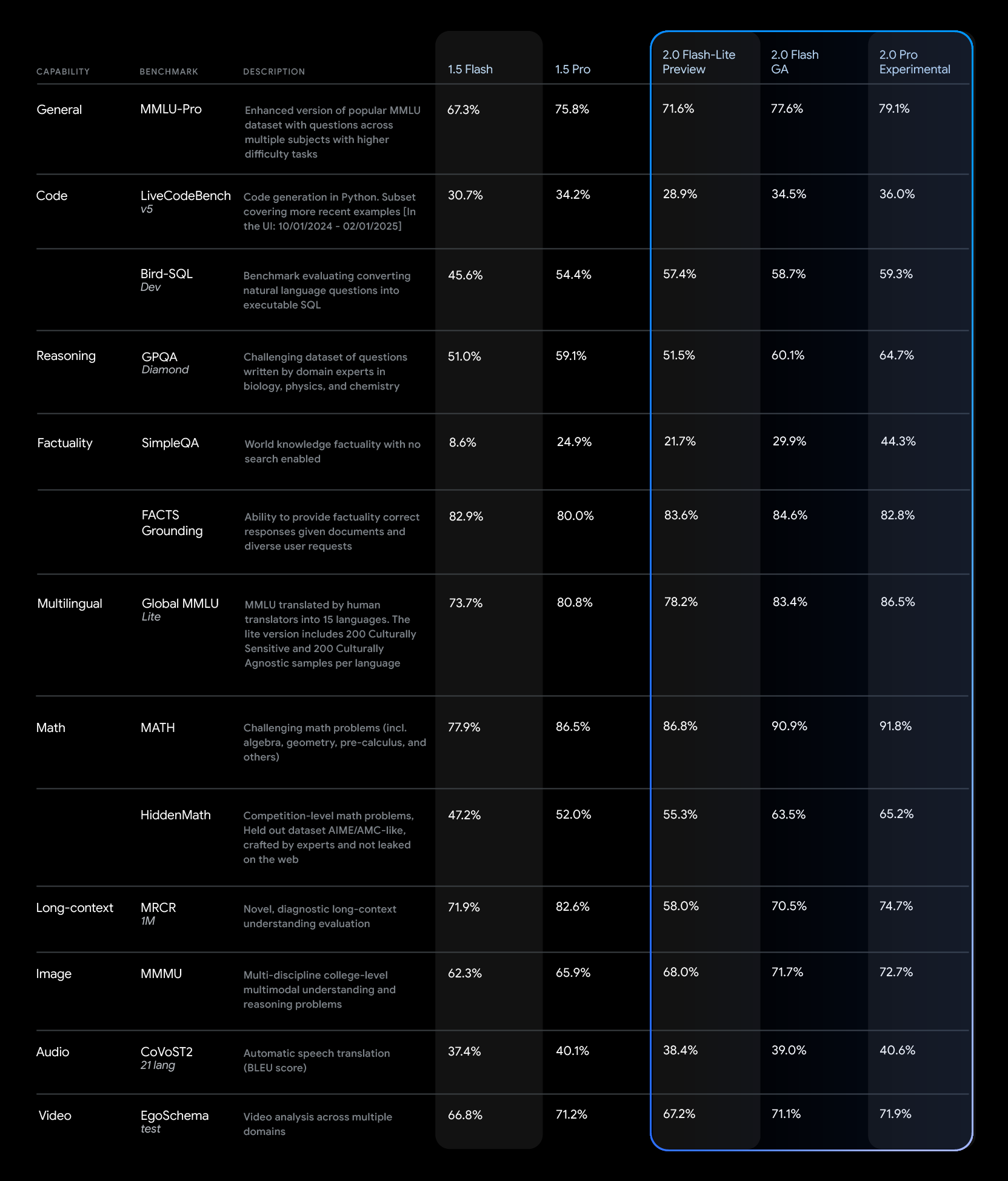

O Google DeepMind relata que o Flash-Lite supera seu antecessor de tamanho normal (mais parametrizado), o Gemini 1.5 Flash, em benchmarks externos como MMLU Pro (77.6% vs. 67.3%) e Bird SQL (57.4% vs. 45.6%), mantendo o mesmo preço e velocidade.

Ele também suporta entrada multimídia e apresenta uma janela de contexto de 1 milhão de tokens, semelhante ao modelo Flash completo.

O Flash-Lite está atualmente disponível em versão prévia pública no Google AI Studio e no Vertex AI, com disponibilidade geral prevista para as próximas semanas.

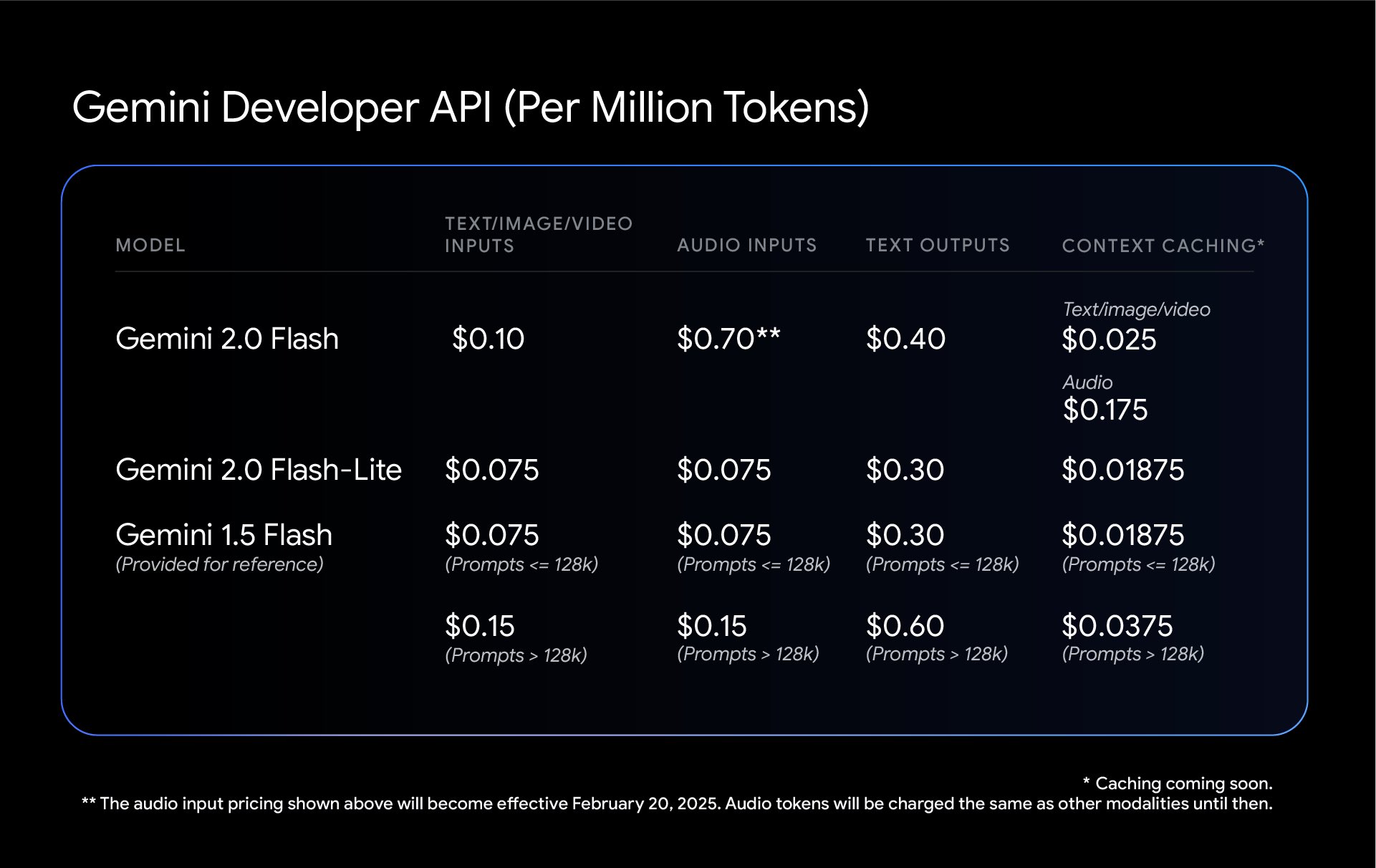

Conforme mostrado na tabela abaixo, o Gemini 2.0 Flash-Lite tem preço de US$ 0.075 por milhão de tokens (entrada) e US$ 0.30 por milhão de tokens (saída). O Flash-Lite é uma opção muito acessível para desenvolvedores, superando o Gemini 1.5 Flash na maioria dos benchmarks, mantendo a mesma estrutura de custos.

Logan Kilpatrick destacou o custo e o valor dos modelos Gemini 2.0 Flash, como Masculino na plataforma X“O Gemini 2.0 Flash oferece o melhor custo-benefício de todos os modelos LLM. É hora de construir!”

Na verdade, em comparação com outros modelos tradicionais de LLM disponíveis por meio da API do provedor, como OpenAI 4o-mini ($0.15/$0.6 por milhão de tokens de E/S) e Claude Antrópico (US$ 0.8/US$ 4! por milhão de tokens de E/S) e até mesmo o tradicional LLM V3 da DeepSeek (US$ 0.14/US$ 0.28), o Gemini 2.0 Flash parece ter o melhor custo-benefício.

Gemini 2.0 Pro Beta chega com 2 milhões de ícones na janela de contexto

O modelo Gemini 2.0 Pro (beta) já está disponível para testes, para usuários que precisam de recursos de IA mais avançados.

O Google DeepMind descreve esse modelo como seu modelo mais poderoso em termos de desempenho de programação e capacidade de lidar com prompts complexos. Ele apresenta uma janela de contexto de 2 milhões de caracteres e recursos de raciocínio aprimorados, com a capacidade de integrar ferramentas externas como a Pesquisa Google e execução de código.

Sam Witteveen, cofundador e CEO da Red Dragon AI e especialista externo em desenvolvimento de aprendizado de máquina no Google, que frequentemente colabora com a VentureBeat, discutiu: Modelo profissional em análise no YouTube. “O novo modelo Gemini 2.0 Pro tem uma janela de contexto com 1.5 milhões de ícones, suporta widgets, execução de código, chamadas de função e integração com a Pesquisa Google — tudo o que tínhamos no Pro XNUMX, mas melhorado.”

Ele também destacou a abordagem iterativa do Google para o desenvolvimento de IA: “Uma diferença fundamental na estratégia do Google é que ele lança versões beta dos modelos antes que eles se tornem disponíveis para o público em geral (GA), permitindo uma iteração rápida com base no feedback”.

Os benchmarks de desempenho demonstram ainda mais os recursos da família de modelos Gemini 2.0. Por exemplo, o Gemini 2.0 Pro supera o Flash e o Flash-Lite em tarefas como raciocínio, compreensão multilíngue e processamento de contexto longo.

Segurança da IA e desenvolvimentos futuros

Segurança da IA e desenvolvimentos futuros

Junto com essas atualizações, o Google DeepMind está implementando novas medidas de segurança para seus modelos Gemini 2.0. A empresa utiliza técnicas de aprendizado de reforço para melhorar a precisão das respostas, usando inteligência artificial para criticar e melhorar seus resultados. Além disso, testes de segurança automatizados são usados para identificar vulnerabilidades, incluindo ameaças indiretas de injeção de reivindicações.

Olhando para o futuro, o Google DeepMind planeja expandir os recursos da família de modelos Gemini 2.0, com métodos adicionais além do texto que devem se tornar disponíveis para o público em geral nos próximos meses.

Com essas atualizações, o Google está fortalecendo sua atuação no desenvolvimento de IA, introduzindo um conjunto de modelos projetados para eficiência, acessibilidade e resolução avançada de problemas, respondendo à ascensão do DeepSeek com seu próprio conjunto de modelos, que variam de poderosos a muito poderosos e muito acessíveis a um pouco menos caros (mas ainda acessíveis).

Isso será suficiente para ajudar o Google a entrar no mercado de IA empresarial, que antes era dominado pela OpenAI e agora é dominado pela DeepSeek? Continuaremos acompanhando e informando você!

Se você quer impressionar seu chefe, o VB Daily vai te ajudar. Fornecemos informações privilegiadas sobre o que as empresas estão fazendo com IA generativa, desde transformações organizacionais até implementações práticas, para que você possa compartilhar insights para maximizar seu ROI.

Segurança da IA e desenvolvimentos futuros

Segurança da IA e desenvolvimentos futuros

Comentários estão fechados.