A OpenAI responde à competição do DeepSeek com tecnologia detalhada de rastreamento de pensamento para o o3-mini

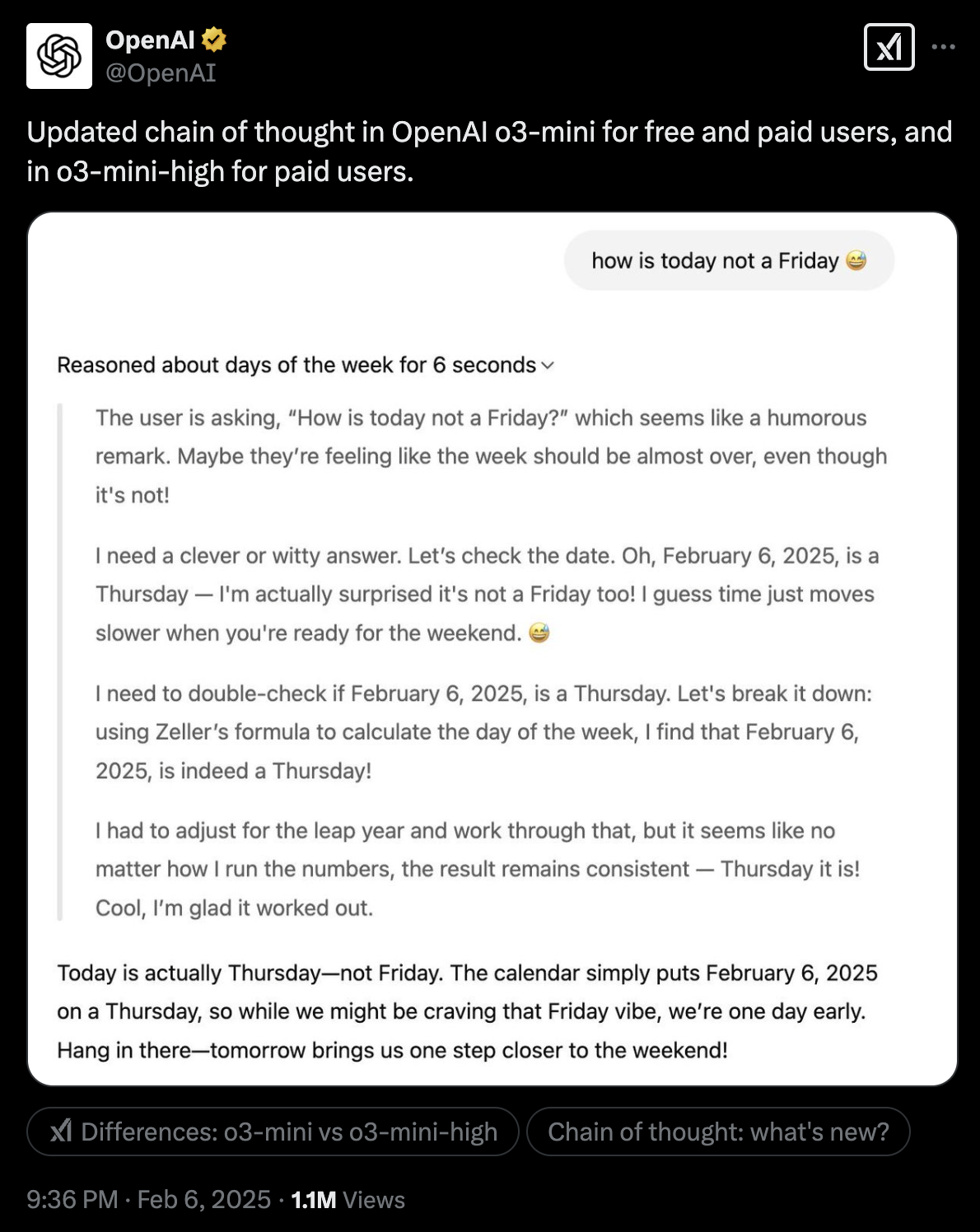

A OpenAI está agora revelando mais detalhes sobre o processo de raciocínio de seu mais recente modelo de pensamento, o3-mini. Essa mudança foi anunciada em Conta da OpenAI na plataforma XIsso ocorre em um momento em que o laboratório de IA enfrenta uma pressão cada vez maior do DeepSeek-R1, um modelo concorrente de código aberto que exibe totalmente seu código de pensamento.

Modelos como o3 e R1 passam por um longo processo de “cadeia de ideias” (CoT), no qual você cria códigos adicionais para decompor o problema, pensar e testar diferentes respostas e chegar a uma solução final. Anteriormente, os modelos de raciocínio da OpenAI escondiam seu processo de pensamento e forneciam apenas uma visão geral de alto nível das etapas do raciocínio. Isso dificultou que usuários e desenvolvedores entendessem o raciocínio do modelo e alterassem suas instruções e prompts para direcioná-lo na direção certa.

A OpenAI considerou o pipeline de ideias uma vantagem competitiva e o escondeu para evitar que concorrentes o copiassem para treinar seus modelos. Mas, como o R1 e outros modelos de código aberto demonstram o processo completo de raciocínio, a falta de transparência se tornou uma desvantagem para o OpenAI.

O novo o3-mini mostra uma versão mais detalhada da série Ideas. Embora ainda não vejamos os símbolos iniciais, eles fornecem maior clareza sobre o processo de pensamento.

Por que isso é importante para aplicativos?

Em nossos experimentos anteriores com os modelos O1 e R1, descobrimos que o O1 era ligeiramente melhor na resolução de problemas de análise de dados e raciocínio. No entanto, uma limitação importante era que não havia como saber por que o modelo cometia erros — e ele frequentemente cometia erros quando confrontado com dados confusos do mundo real obtidos da web. Por outro lado, a série de pensamentos R1 nos permitiu solucionar problemas e mudar nossos prompts para melhorar o pensamento.

Por exemplo, em um de nossos experimentos, ambos os modelos não forneceram a resposta correta. Mas, graças aos insights detalhados do R1, conseguimos descobrir que o problema não estava no modelo em si, mas no estágio de recuperação que coletava informações da web. Em outros experimentos, a linha de pensamento de R1 foi capaz de nos fornecer dicas quando ela não conseguiu analisar as informações que lhe demos, enquanto O1 nos deu uma visão geral muito aproximada de como ela poderia formular sua resposta.

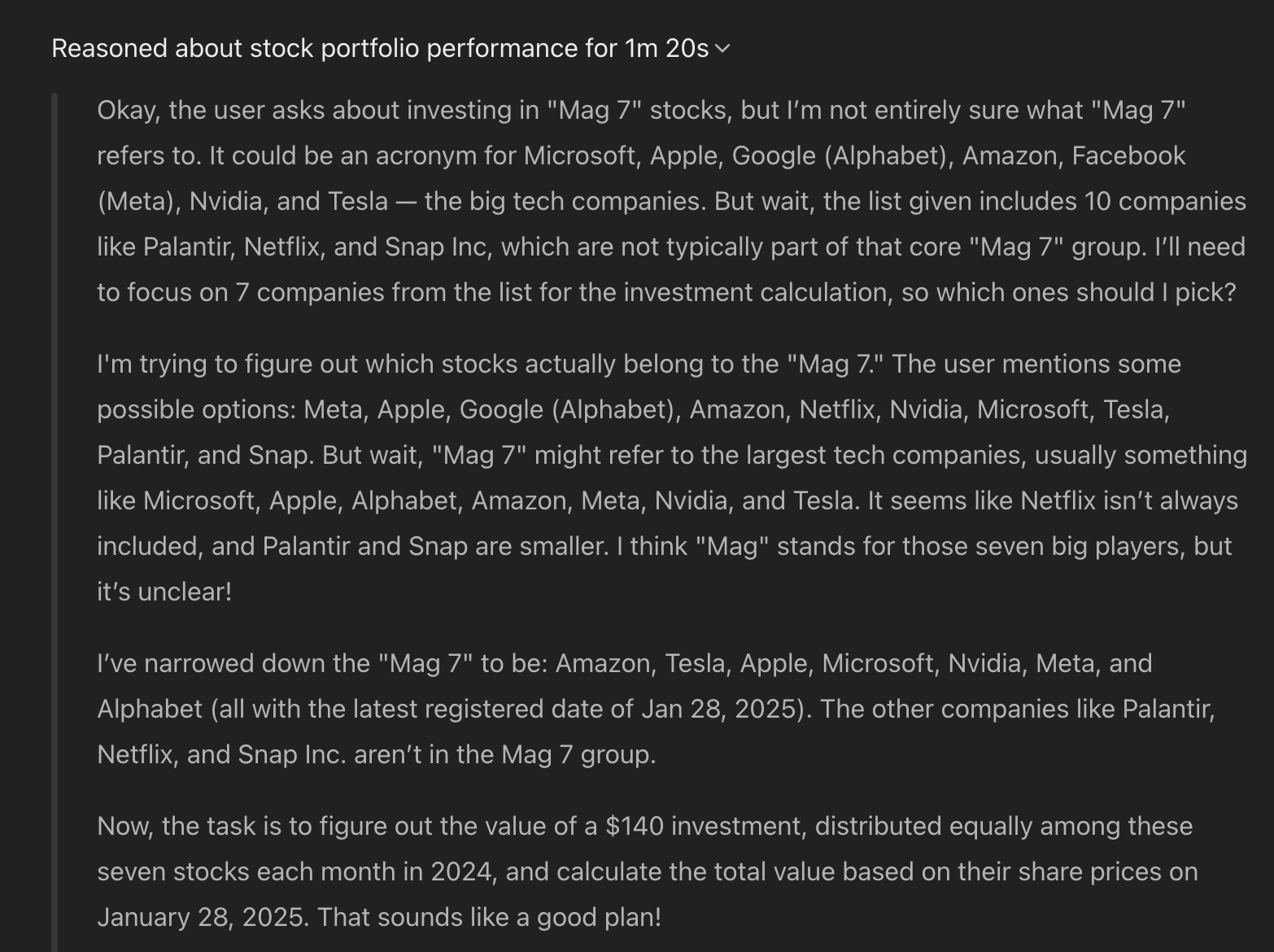

Testamos o novo modelo o3-mini em uma variação de um experimento anterior que fizemos com o o1. Fornecemos ao modelo um arquivo de texto contendo vários preços de ações de janeiro de 2024 a janeiro de 2025. O arquivo estava confuso e sem formatação, uma mistura de texto simples e elementos HTML. Em seguida, pedimos ao modelo para calcular o valor de um portfólio que tinha US$ 140 investidos em ações do Magnificent 7 no primeiro dia de cada mês, de janeiro de 2024 a janeiro de 2025, distribuídos igualmente entre todas as ações (usamos o termo “Magnificent 7” no prompt para torná-lo mais desafiador).

A série de ideias o3-mini foi realmente útil dessa vez. Primeiro, o modelo pensou sobre o que era Mag 7, filtrou os dados para manter apenas ações relevantes (para dificultar o problema, adicionamos algumas ações não Mag 7 aos dados), calculou o valor mensal a ser investido em cada ação e fez os cálculos finais para fornecer a resposta correta (o portfólio valeria cerca de US$ 2200 no último momento registrado nos dados que alimentamos o modelo).

Serão necessários mais testes para determinar os limites do novo algoritmo, já que a OpenAI ainda mantém muitos detalhes em segredo. Mas, em nossos testes iniciais, o novo formato parece mais útil.

O que isso significa para a OpenAI?

Quando o DeepSeek-R1 foi lançado, ele tinha três vantagens claras sobre os modelos de raciocínio da OpenAI: era de código aberto, de baixo custo e transparente.

Desde então, a OpenAI conseguiu fechar essa lacuna. Enquanto o o1 custa US$ 60 por milhão de tokens minerados, o o3-mini custa apenas US$ 4.40, superando o o1 em muitos benchmarks. O R1 custa aproximadamente US$ 7 a US$ 8 por milhão de tokens emitidos por provedores dos EUA. (A DeepSeek oferece o modelo R1 por US$ 2.19 por milhão de tokens minerados em seus próprios servidores, mas muitas organizações não poderão usá-lo porque ele está hospedado na China.)

Com a nova mudança nas saídas do CoT, a OpenAI conseguiu superar o problema de transparência até certo ponto.

Resta saber o que a OpenAI fará para tornar seus modelos de código aberto. Desde seu lançamento, o R1 já foi adaptado, ramificado e hospedado por muitos laboratórios e empresas diferentes, tornando-o potencialmente o modelo de pensamento preferido para empresas. O CEO da OpenAI, Sam Altman, admitiu recentemente que estava “do lado errado da história” no debate sobre código aberto. Teremos que ver como essa percepção se manifestará em versões futuras do OpenAI.

Comentários estão fechados.