Google suspende proibição de IA em armas e vigilância: um futuro perturbador para a tecnologia avançada

O Google revogou sua proibição de longa data sobre o uso de inteligência artificial em armas e sistemas de vigilância, sinalizando uma grande mudança na postura ética da empresa sobre o desenvolvimento de IA, que ex-funcionários e especialistas do setor dizem que pode remodelar a maneira como o Vale do Silício aborda a segurança da IA.

Esta mudança, que foi implementada discretamente esta semana, elimina partes importantes do Princípios de IA do Google que proibia explicitamente a empresa de desenvolver IA para armas ou vigilância. Estes eram os princípios que Foi criado em 2018., servindo como referência da indústria para o desenvolvimento responsável de IA.

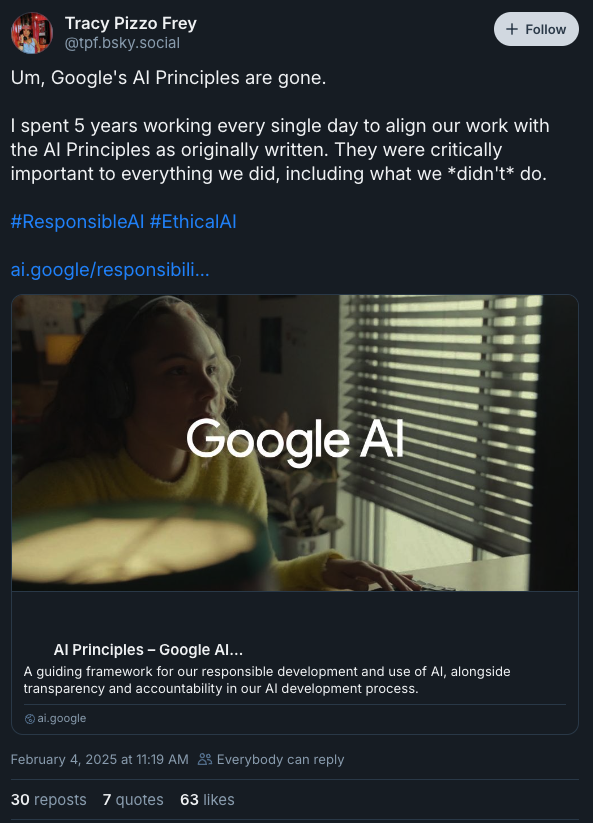

Tracy Pizzo-Fry, que passou cinco anos implementando os princípios nativos de IA do Google como diretora sênior de gerenciamento de produtos de saída, engajamento e IA responsável no Google Cloud, escreveu em uma postagem no Céu azul“O último bastião caiu. O Google foi realmente o único a ser tão claro sobre seus compromissos com o que construirá.”

Tracy Pizzo-Fry, que passou cinco anos implementando os princípios nativos de IA do Google como diretora sênior de gerenciamento de produtos de saída, engajamento e IA responsável no Google Cloud, escreveu em uma postagem no Céu azul“O último bastião caiu. O Google foi realmente o único a ser tão claro sobre seus compromissos com o que construirá.”

Os princípios revisados removem quatro proibições específicas: tecnologias que provavelmente causarão danos públicos; e aplicações de armas; e sistemas de monitoramento; e tecnologias que violam o direito internacional e os direitos humanos. Em vez disso, ela diz, Google Agora, trabalhará para “mitigar consequências não intencionais ou prejudiciais” e será consistente com “princípios amplamente aceitos do direito internacional e dos direitos humanos”.

A flexibilização das restrições éticas da IA pelo Google: o que isso significa para tecnologias de vigilância e aplicações militares?

Essa mudança ocorre em um momento muito delicado, pois os recursos de IA estão avançando rapidamente e os debates sobre controles apropriados para essa tecnologia estão se intensificando. O momento levantou questões sobre os motivos do Google, embora a empresa sustente que essas mudanças estão em desenvolvimento há muito tempo.

“Estamos em uma situação em que há muita desconfiança nas grandes empresas de tecnologia, e cada passo que parece remover controles gera mais desconfiança”, disse Bezo-Fry em entrevista ao VentureBeat. Ela enfatizou que limites éticos claros eram essenciais para a construção de sistemas de IA confiáveis durante sua gestão no Google.

Os princípios originais surgiram em 2018 em meio a protestos de funcionários sobre Projeto Maven, um contrato com o Pentágono que inclui o uso de inteligência artificial para analisar imagens de drones. Embora o Google tenha se recusado a renovar este contrato, as novas mudanças podem sinalizar uma abertura para parcerias militares semelhantes.

A emenda mantém alguns elementos da estrutura ética anterior. Para o GoogleMas ele passa da proibição de aplicativos específicos para a ênfase na gestão de riscos. Essa abordagem está mais alinhada aos padrões da indústria, como: Estrutura de gerenciamento de risco NIST AI, embora os críticos digam que ele oferece restrições menos rigorosas a aplicativos potencialmente prejudiciais.

“Considerações éticas são tão importantes quanto criar uma boa IA, mesmo que a precisão não seja a mesma”, observou Bezo Fry, destacando como as considerações éticas melhoram a eficácia e a acessibilidade dos produtos de IA.

Do Projeto Maven à Transformação Política: o Caminho da Reforma Ética da IA do Google

Observadores da indústria dizem que essa mudança de política pode influenciar a maneira como outras empresas de tecnologia abordam a ética da IA. Os princípios originais do Google estabeleceram um precedente para a autorregulamentação corporativa no desenvolvimento de IA, com muitas empresas recorrendo ao Google para obter orientação sobre implementação responsável de IA.

A emenda reflete tensões mais amplas no setor de tecnologia entre inovação rápida e restrições éticas. À medida que a competição no desenvolvimento de IA se intensifica, as empresas enfrentam pressão para equilibrar o desenvolvimento responsável com as demandas do mercado.

“Estou preocupado com a rapidez com que as coisas se espalharão pelo mundo e se a Plus and Plus será removida das restrições”, disse Pitso Frei, expressando preocupação com a pressão competitiva para lançar produtos de IA rapidamente sem avaliar adequadamente as potenciais consequências.

O dilema ético das grandes empresas de tecnologia: a mudança na política de IA do Google estabelecerá um novo padrão no setor?

A revisão também levanta questões sobre os processos internos de tomada de decisões do Google e como os funcionários podem abordar considerações éticas sem proibições explícitas. Durante sua gestão no Google, Bezo-Fry criou processos de revisão que reuniram diversas perspectivas para avaliar os impactos potenciais das aplicações de IA.

Embora o Google mantenha seu compromisso com o desenvolvimento responsável de IA, a remoção de proibições específicas representa um afastamento significativo de seu papel de liderança anterior em estabelecer limites éticos claros para aplicações de IA. À medida que a IA continua avançando, o campo está monitorando como essa mudança pode impactar o cenário mais amplo de desenvolvimento e regulamentação da IA.

Comentários estão fechados.