Eu vivenciei a encarnação do Gemini Live para entender o mundo: Choque!

É enervante ouvir uma IA falar num tom estranhamente amigável e me pedir para limpar a bagunça na minha estação de trabalho. Estou bastante orgulhoso disso, mas acho que está na hora de empilhar as ferramentas espalhadas aleatoriamente e arrumar a bagunça de fios.

Minha irmã também concordaria. Mas entrar em ação depois que a IA “vê” minha mesa, reconhece a desordem e oferece dicas de limpeza é o panorama geral. O chatbot Gemini AI do Google agora pode fazer exatamente isso. E muito mais.

O segredo aqui é uma atualização de recurso recente chamada Projeto Astra. Ele está em desenvolvimento há anos e finalmente começou a ser lançado no início deste mês. A ideia geral é entregar uma IA que tudo vê, tudo ouve e abertamente inteligente no seu telefone.

O Google comercializa esses superpoderes sob um nome nada inspirador: Gemini Live com Câmera e Compartilhamento de Tela. Desenvolvido pela unidade DeepMind da empresa, a empresa começou a desenvolvê-lo como um assistente de IA universal. É uma pena que o nome final não seja ambicioso.

Vamos começar com o modo de acesso. A capacidade agora está disponível para os usuários. 9 pixels و Galaxy S25. Mas se você tiver um telefone Android com uma assinatura Gemini Advanced para usar com ele, você pode acessar o novo kit de ferramentas.

A propósito, isso daria US$ 20 por mês. Testei nos dois telefones acima e agora está funcionando no meu OnePlus 13 também. A parte mais doce? Você não precisa passar por nenhuma dificuldade técnica para chegar lá.

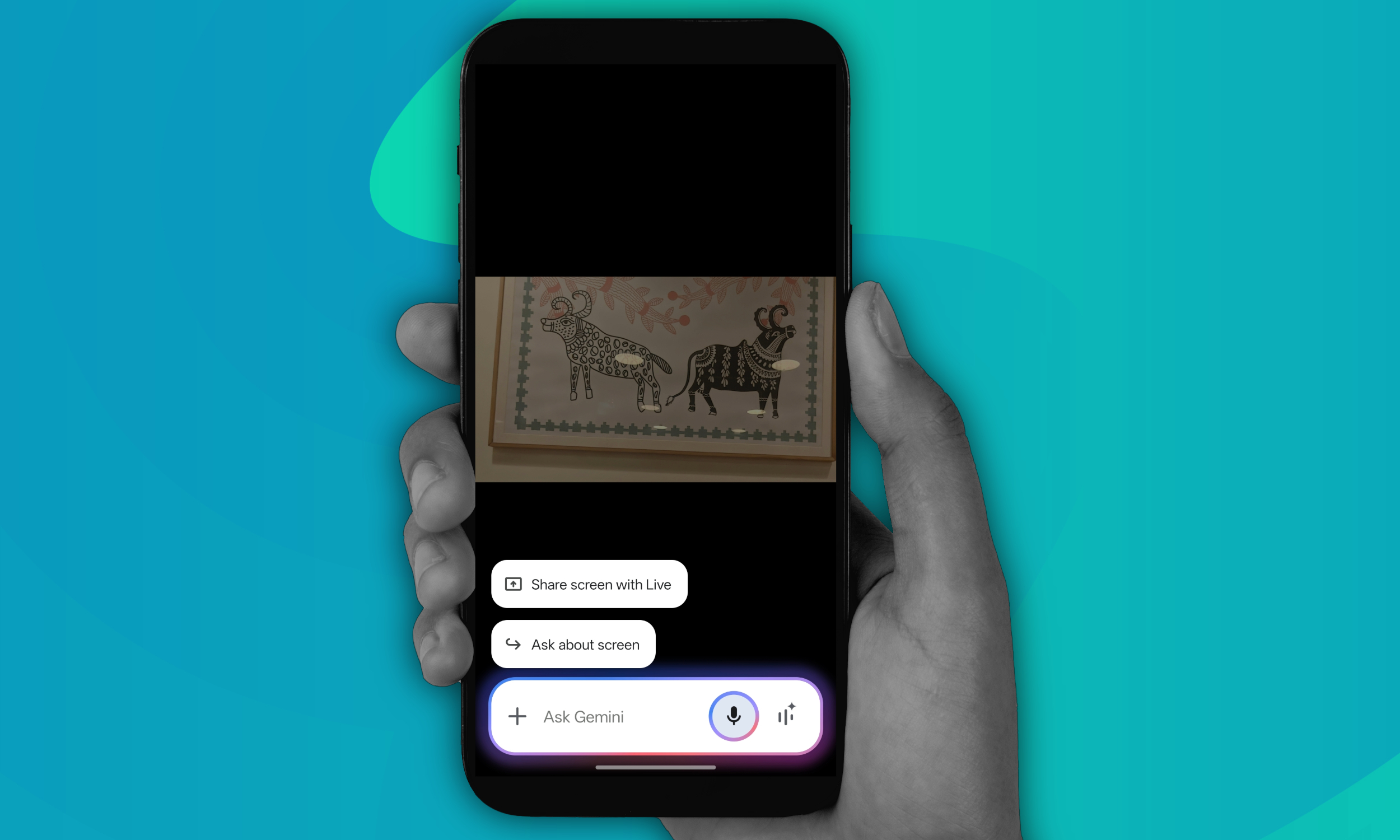

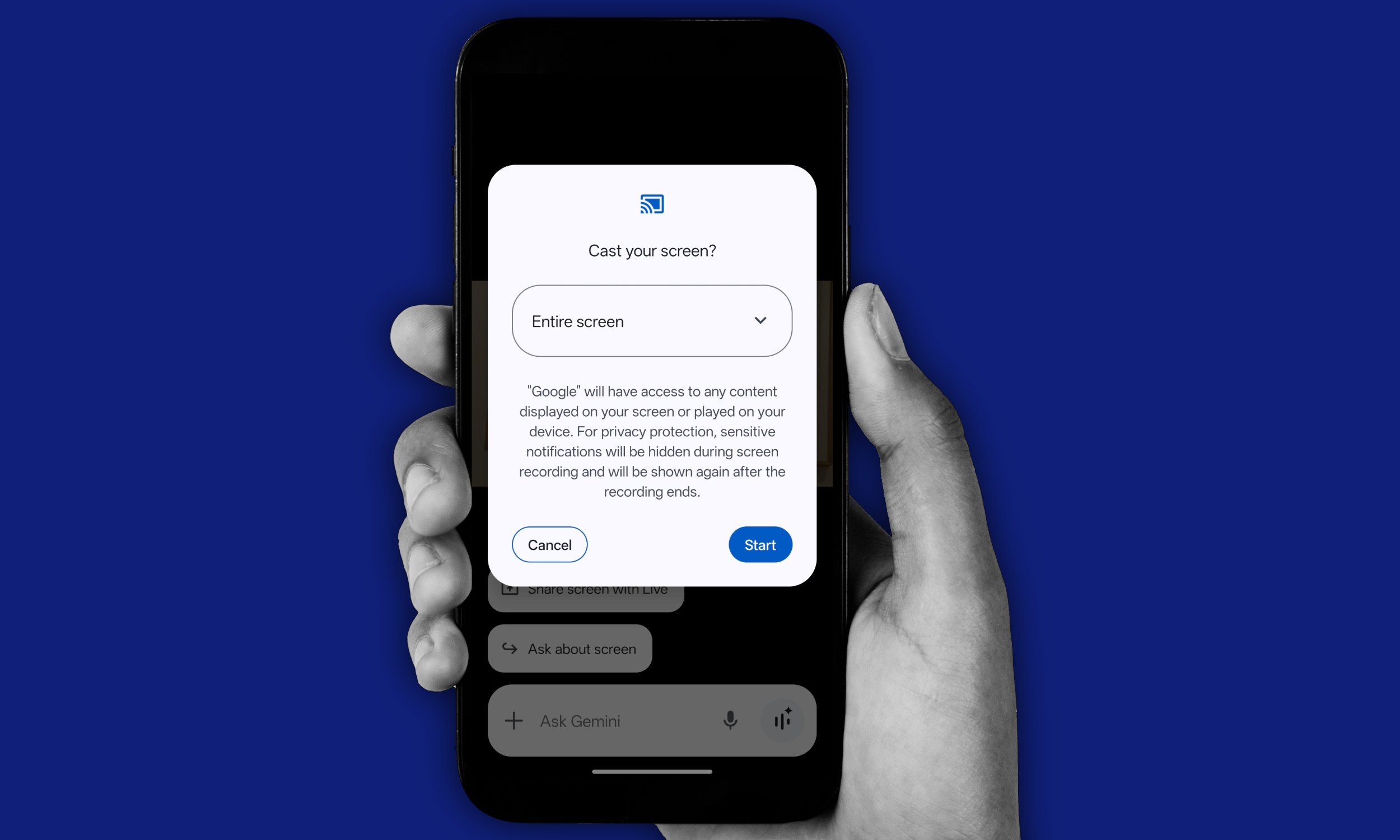

Tudo o que você precisa é de uma combinação dos botões de energia/volume ou deslizar o canto da tela para chamar o Gemini. Não importa qual aplicativo você esteja executando, você pode acessar uma nova câmera e compartilhamento de tela como uma sobreposição em cada canto do sistema operacional.

Compreendendo o mundo ao seu redor

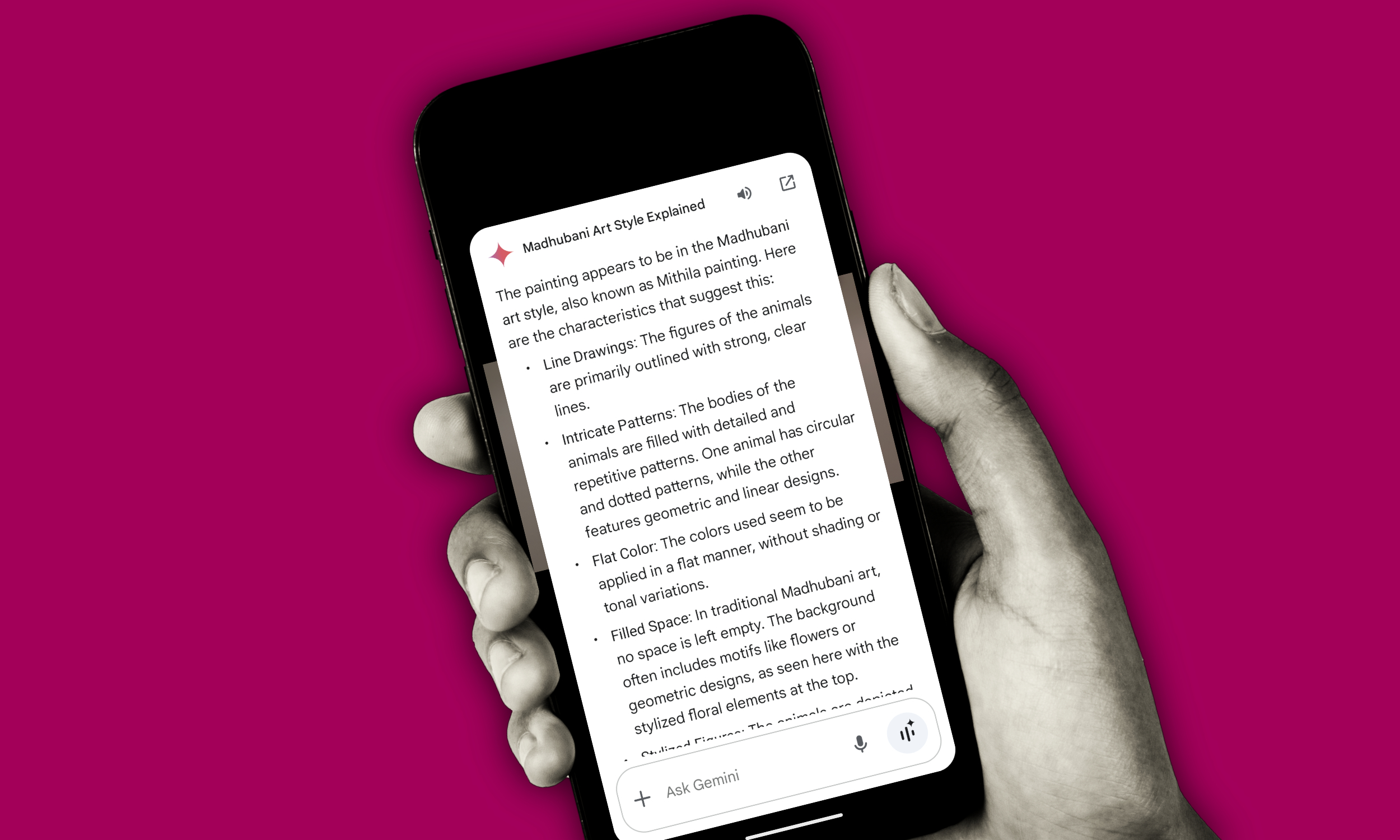

Comecei a apontar a câmera para uma pintura e perguntei sobre ela. O Gemini Live conseguiu detectá-lo com precisão como uma pintura no estilo Madhubani, decifrando o uso ousado de cores e a representação de animais.

Ele então me deu uma breve lição de história e as diferenças que surgiram ao longo dos anos. As informações eram precisas, até o nível mais ínfimo. Felizmente, você também pode optar por ter uma conversa por texto com Gêmeos, se estiver em um lugar onde conversas por voz podem ser desconfortáveis.

O que mais gosto no novo recurso de câmera e compartilhamento de tela do Gemini Live é que ele não é muito tagarela. Você pode interromper a qualquer momento, o que aumenta o apelo das conversas “naturais”.

Experimentei o Gemini em vários cenários. Eu não estava preparado para isso.

As respostas que ele dá geralmente são breves, como se ele quisesse lhe dar uma chance (ou até mesmo um empurrãozinho) para fazer uma pergunta complementar em vez de dar uma resposta muito longa. Ele se destaca em uma ampla gama de temas e cenários visuais, mas há algumas armadilhas.

Ele ainda não pode usar o Google Lens, o que significa que o Gemini não pode comparar as imagens que vê na tela do seu telefone com resultados correspondentes na web. Além disso, ele não pode acessar informações em tempo real se você pedir ao Gemini para pesquisar os últimos desenvolvimentos sobre um tópico ou personagem.

Perguntei a ele sobre espécies de plantas, cardápios de restaurantes, captura de dados de painéis de avisos e minha receita para uma gripe recente. O Gemini teve um desempenho muito bom, melhor do que qualquer chatbot de IA que já experimentei até agora.

Liberando o Banco de Conhecimento: Uma Análise Aprofundada

Em seguida, Gêmeos estimula você a entender assuntos acadêmicos complexos. Coloquei um livro sobre aprendizado de máquina no enquadramento da câmera. A Gemini Live não só reconheceu isso como também me deu uma visão geral do conteúdo e dos temas principais do livro. Essa habilidade reflete uma compreensão avançada de aprendizado de máquina e a capacidade de resumir informações complexas.

Curiosamente, comecei a folhear as páginas e me deparei com a lista de capítulos. A IA reconheceu o progresso, parou de falar e me perguntou se eu estava interessado em alguma aula específica agora que eu estava verificando a lista de tópicos. Esse recurso demonstra a capacidade do Gemini de se adaptar e responder em tempo real à interação do usuário, tornando-o uma ferramenta poderosa para aprendizado interativo.

Fiquei completamente surpreso naquele momento.

Pedi à IA para analisar alguns tópicos complexos, e ela fez um trabalho respeitável, indo além do material da página e extraindo de seu próprio vasto banco de conhecimento.

Por exemplo, quando perguntei sobre o conteúdo da página introdutória do romance “Tamas” de Bhisham Sahni, a IA detectou corretamente a referência ao Prêmio Sahitya Akademi. Ele então mencionou detalhes que nem estavam listados na página, como o ano em que ela ganhou o prestigioso prêmio literário e sobre o que é o romance. Isso demonstra a capacidade da IA de entender o contexto e extrair informações adicionais.

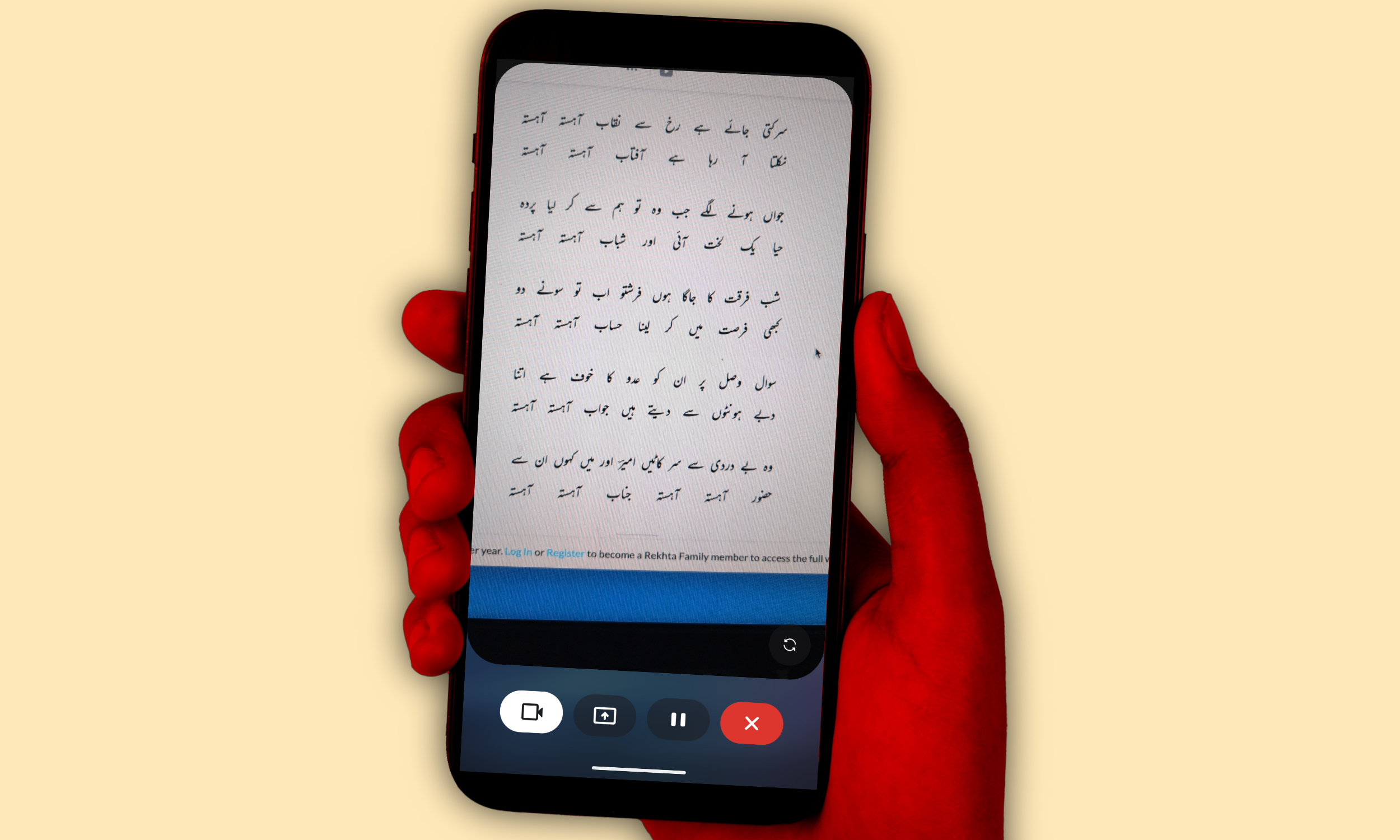

Por outro lado, ler hindi com o Gemini Live foi horrível. Não era apenas um sotaque ruim, Geminiano falava com frequência coisas sem sentido e sem sentido. Ao tentar ler urdu, persa e árabe, ele se saiu consideravelmente melhor, mas frequentemente misturava palavras de linhas aleatórias. Isso indica que o desempenho do Gemini varia de acordo com o idioma e pode precisar de melhorias significativas em alguns idiomas.

Na minha primeira tentativa com poesia urdu, ele não apenas reconheceu o texto urdu, mas também fez um resumo preciso do poema. O maior desafio, novamente, foi a narrativa. Ouvir a versão em inglês do urdu realmente machucou meus ouvidos. Isso destaca a importância da pronúncia e da qualidade do sotaque na experiência do usuário, especialmente quando se lida com línguas estrangeiras.

se destaca em lugares inesperados

A inteligência artificial é uma ótima ferramenta de resolução de problemas, e há muitos parâmetros que comprovam isso. Testei-o em problemas de física relacionados à termodinâmica, equações eletroquímicas e problemas de estatística que apareciam em um caderno manuscrito. A Gemini Live fez um ótimo trabalho nessas tarefas.

Ele também se destacou em tarefas criativas. Minha irmã, uma designer de moda, mostrou um de seus esboços na câmera, pedindo feedback e melhorias. O Gemini Live começou elogiando o design, fazendo comparações com as ideologias de design de algumas marcas de moda e oferecendo algumas recomendações. Essas recomendações foram muito úteis para melhorar o design.

Quando a AI foi incentivada a apresentar o Plus, ele também aconselhou minha irmã sobre as melhores ferramentas para converter esboços feitos à mão em conceitos digitais. Ele complementou essas orientações com informações úteis sobre o pacote de software e onde encontrar materiais instrucionais. Esses conselhos foram inestimáveis para otimizar o processo de design digital.

Quando coloquei um par de pilhas Duracell no campo de visão da câmera, ela não apenas as reconheceu com precisão, mas também me indicou plataformas de comércio eletrônico locais que poderiam entregá-las a mim em minutos. Essa capacidade tem sido particularmente útil na identificação de produtos e sua disponibilidade local.

Os serviços — chamados Blinkit e Swiggy Instamart — estão disponíveis apenas na Índia e são destinados principalmente a locais urbanos. Mesmo em uma sala mal iluminada, ele conseguiu identificar um par de fones de ouvido com fio na primeira tentativa. Isso demonstra a capacidade da inteligência artificial de reconhecer objetos em diferentes condições.

A consciência situacional é seu principal ponto forte.

Em comparação com um bate-papo regular do Gemini ou o que você encontra na seção de visão geral da IA da Pesquisa Google, os bate-papos do Gemini Live adotam uma abordagem mais cautelosa para distribuir conhecimento, especialmente se for de natureza sensível. Percebi que tópicos como recomendações alimentares e tratamento médico estão sendo tratados com uma abordagem cada vez mais cautelosa, muitas vezes direcionando os usuários a encontrar o recurso especializado apropriado. Esse cuidado reflete o foco do Google em fornecer informações precisas e confiáveis, especialmente em áreas que exigem conhecimento especializado.

Alguns desafios familiares

Minha principal conclusão é que a transformação do Projeto Astra em Gemini é muito impressionante. É um vislumbre do futuro do que os smartphones podem alcançar. Com algumas melhorias, integrações e fluxos de trabalho entre aplicativos, a Pesquisa Google pode fazer você se sentir uma relíquia. Mas, no momento, há algumas falhas gritantes.

Em algumas ocasiões, percebi que meu sistema de memória estava ficando descontrolado. Quando a IA foi solicitada a identificar uma pulseira fitness na visualização da câmera, ela a identificou corretamente como um Samsung Galaxy Fit 3. Mas quando fiz uma pergunta complementar, o dispositivo foi identificado erroneamente como uma pulseira fitness da Huawei.

Ele também pode mentir descaradamente. E com total confiança, eu poderia dizer. Por exemplo, quando pedi para resumir minha análise do wearable, a IA respondeu que a Digital Trends ainda não o havia analisado. Na verdade, o artigo foi publicado há uma semana.

Em seguida, pedi que ele navegasse por alguns artigos na minha página de autor após habilitar o compartilhamento de tela. Gemini fez um bom trabalho explicando as histórias, mas às vezes tropeçou na compreensão contextual. Por exemplo, ele afirmou incorretamente que apenas a Intel e a AMD poderiam tornar Unidades de Processamento Neural (NPUs) elegíveis para o selo. Copiloto+.

Por outro lado, o artigo afirma claramente que a Qualcomm foi a primeira a atingir esse padrão, à frente da concorrência. Foi somente no final do ano passado que a AMD e a Intel finalmente conseguiram se destacar e atingir o patamar de chips de IA com uma nova linha de processadores.

No meio de uma conversa sobre um artigo, ele teve novamente um problema de memória. Em vez de resumir a história em discussão, ele voltou a falar sobre o primeiro artigo que viu no compartilhamento de tela. Quando o interrompi no meio da narração, Gemini corrigiu seu erro.

Outro problema que notei com a narração em outros idiomas que não o inglês foi que o Gemini Live mudava aleatoriamente a voz e a velocidade no meio da narração. Era extremamente irritante, e a pronúncia era completamente robótica, completamente diferente de suas habilidades humanas com o inglês.

Dificuldades de visão de máquina também surgem com linhas elegantes. Em algumas ocasiões, ele cuspiu informações incorretas com confiança e, quando solicitada a se corrigir, a IA expressou sua incapacidade de encontrar as informações mais atualizadas sobre o assunto. Esses cenários são raros, mas os erros de Gêmeos continuam.

Para resumir, acho que o Gemini Live, com sua câmera e compartilhamento de tela, é um dos maiores avanços que a IA já fez até agora. É uma das aplicações mais práticas e gratificantes da IA generativa até hoje. Tudo o que ele precisa é de um pouco de variedade e uma solução para sua síndrome de “mentiroso confiante”.

As coisas estão definitivamente no caminho certo agora, em grande parte, mas ainda estamos a alguns marcos críticos de sermos a companheira de IA perfeita para os sonhos tecno-futuristas.

Comentários estão fechados.