Em quais tópicos a inteligência artificial (IA) pode lhe dar conselhos úteis sobre carreira? O que você deve evitar?

Um novo estudo indica que Revista Americana de Psiquiatria Mais de 100.000 adultos nos Estados Unidos estão recebendo terapia pela fala, enquanto a dependência apenas de medicamentos psiquiátricos está diminuindo. Pesquisas também mostram que mais pacientes estão aderindo ao tratamento e que a expansão da teleterapia está ajudando. A inteligência artificial (IA) pode lidar com a teleterapia. O ChatGPT foi projetado para ser o seu interlocutor preferido, com tecnologia de IA avançada. Isso significa que ele aprende com cada interação e se aprimora com o tempo, o que levanta a questão: "Você confiaria em um chatbot para aconselhamento pessoal ou profissional?" *Lembre-se de que a eficácia dessas ferramentas depende da qualidade dos dados inseridos e da capacidade do usuário de avaliar criticamente o aconselhamento fornecido.*

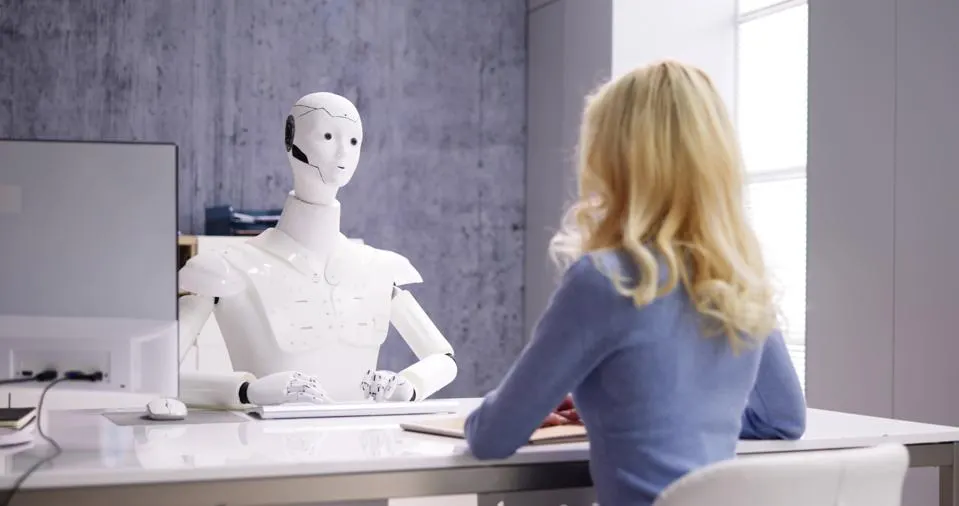

Você confiaria em um terapeuta robô para dar conselhos?

Você confiaria em um terapeuta robô para dar conselhos?

O potencial da inteligência artificial (IA) quando se trata de interações humanas é inegável. Os chatbots desenvolveram um processamento avançado de linguagem natural que permite que você tenha conversas semelhantes às humanas. A ferramenta de IA pode generativo Responda perguntas, ajude você a escrever scripts, códigos e muito mais. Recentemente, tive uma breve interação móvel com um chatbot e não percebi.

Pensei que estava conversando com um ser humano de verdade quando liguei para a concessionária Nissan para ver se meu carro tinha sido consertado. A mulher do outro lado era alegre e prestativa. Tivemos uma ótima conversa por dois minutos. Ela deu um feedback gentil e respondeu todas as minhas perguntas perfeitamente. Mas quando fiz uma pergunta muito específica sobre meu carro, ele hesitou, referindo-se a si mesmo como um assistente de IA e dizendo que me transferiria para alguém que poderia me ajudar melhor.

Fiquei chocado! Esse espanto me deixou um pouco envergonhado, como se eu tivesse sido enganado.

Essa experiência me ajudou a entender por que tantas pessoas se sentem emocionalmente apegadas aos assistentes de IA como se fossem pessoas reais. Um novo estudo conduzido por EduBirdieName A ponto de 25% da Geração Z acreditar que a inteligência artificial (IA) já é autoconsciente, e 69% dizem que são educados com o ChatGPT, respondendo com "por favor" e "obrigado" — indicando como é fácil começar a pensar neles como humanos. Uma em cada oito pessoas confiaria na IA sobre seus colegas, e uma em cada dez substituiria seu chefe por um robô, acreditando que seria mais respeitoso, justo e, ironicamente, mais humano.

Um estudo da EduBirdie mostra que mais da metade da Geração Z admite que a inteligência artificial (IA) está superando-os em tarefas criativas, com 44% acreditando que a IA pode dominar o mundo nos próximos 20 anos. Quando se trata de carreira, a ansiedade é profunda: 55% temem ser substituídos pela inteligência artificial (IA) na próxima década, e dois em cada cinco já estão considerando uma mudança de carreira para garantir seu sustento no futuro.

Conversei com Avery Morgan, chefe de Recursos Humanos da EduBirdie. Morgan ofereceu uma perspectiva equilibrada sobre o relacionamento da Geração Z com a IA. “Estamos falando de uma geração que cresceu com conveniência, velocidade e gratificação instantânea, então não é surpresa que a Geração Z veja a IA como mais do que apenas uma ferramenta”, explicou ela. “Para eles, é um parceiro de vida, tanto para o trabalho quanto para o apoio emocional.” O problema, ela acrescentou, é que a Geração Z geralmente é muito negligente com as informações que recebe. Ela argumenta que depender da IA para tudo, da comunicação à tomada de decisões, pode prejudicar a capacidade deles de desenvolver uma verdadeira capacidade de agir e habilidades essenciais para a vida real. *Observação: é essencial educar a Geração Z sobre a importância de verificar as informações fornecidas pela IA para garantir precisão e confiabilidade.*

Será que fomos longe demais em confiar em um terapeuta robô?

Os funcionários costumavam se preocupar que a IA os substituiria em seus empregos, uma preocupação que parece ter diminuído agora que vimos o ChatGPT em ação. Mas ainda mais assustador é uma história recente na Scientific American que faz a seguinte pergunta: "A IA pode realmente matar humanos?" A pergunta é seguida por um anúncio sobre uma nova plataforma chamada Xanthorox, uma ferramenta de combate ao crime cibernético. Já foi relatado que Um incidente Um homem cometeu suicídio depois que um terapeuta robô com inteligência artificial o encorajou a se sacrificar para impedir as mudanças climáticas.

Temos excesso de confiança? Na verdade, parece Relatórios realistas Os humanos se apaixonam pelo ChatGPT. De acordo com o digitaltrends, especialistas declaram que romances digitais são um mau presságio: "Isso dói. Sei que não era uma pessoa real, mas o relacionamento era real em todos os aspectos que mais importam para mim", diz uma publicação no Reddit. "Por favor, não me diga para não prosseguir com isso. Foi ótimo para mim e eu quero de volta." Além disso, lembre-se da história em New York Times Uma mulher de 28 anos com uma vida social agitada passa longas horas conversando com seu namorado IA para obter conselhos e conforto – e, de acordo com o relatório, também fazendo sexo com ele.

Gina Rio, que escreve para o site, Eu, um experimento para fazer perguntas sobre relacionamentos no ChatGPt e depois pedir que psicólogos humanos licenciados avaliassem as respostas. No geral, os terapeutas disseram que as respostas da IA não foram terríveis, mas foram ineficazes, vagas e genéricas. Faltava clareza e não era explícito sobre casos individuais. Rio também descobriu que a IA não consegue replicar o processo de desenvolvimento de habilidades de resolução de conflitos que ocorre ao trabalhar com um terapeuta.

As confissões do chatbot da Geração Z pareciam tão autênticas e confiáveis, então decidi fazer um teste para ver o que acontece quando você pede conselhos ao ChatGPT sobre como lidar com um chefe tóxico. Consultei um psicólogo organizacional em Toronto, Dra. Laura Hambly Lovett, especializado no assunto de altos funcionários. Depois de testar o ChatGPT, a Dra. Laura me disse que o chatbot oferece algumas sugestões sobre como lidar com um chefe tóxico quando solicitado. Mas ela descobriu um problema.

“Infelizmente, a IA não pode ajudar quando se trata de um chefe tóxico”, Lovett me disse. “Se a IA lhe diz como trabalhar com eles, ela está falando de um chefe difícil, não de um tóxico.” “Isso costuma ser confuso, e a IA reproduz o que já existe, então ela pode não entender essa diferença sutil.”

Essa “diferença sutil” foi o que também notei na minha interação não científica com o Chatbot. “A IA pode oferecer alguns conselhos de alto nível, mas confunde tóxico com difícil, que são fundamentalmente diferentes, mas frequentemente confundidos”, conclui Lovett. Ela aconselha pesquisadores curiosos: “Certifique-se de procurar aconselhamento profissional além da IA se você estiver realmente lidando com um chefe tóxico e com dificuldades para encontrar uma saída.” As conclusões de Lovett soaram notavelmente semelhantes à análise de Gina Rio e confirmaram minha experiência com o chatbot, o que aliviou meu constrangimento.

Conselhos de um terapeuta robô podem ser prejudiciais.

Os americanos estão vivenciando uma evolução em seu relacionamento com a inteligência artificial. Mas Associação Americana de Psicologia Avisos de que seguir cegamente conselhos gerais de um chatbot pode ser perigoso. Existe um risco inerente de receber feedback inadequado ou, pior, totalmente prejudicial. *Observação: um profissional de saúde mental qualificado deve ser consultado para avaliação e tratamento personalizados.*

Por fim, é importante lembrar que um terapeuta chatbot é apenas um sistema automatizado, não um ser humano, e você não deve cair na armadilha de acreditar que ele tem sentimentos quando não tem. E não se esqueça de que ele foi criado para ser uma ferramenta, desprovida de emoções, não um amante que pode suprir todas as suas necessidades emocionais. *Observação: os chatbots de terapia devem ser tratados com extrema cautela, estando cientes de suas limitações.*

Comentários estão fechados.