Microsoft lança Phi-4: um modelo de IA superinferencial para competir com o DeepSeek R1

Resumo:

- A Microsoft lançou modelos de IA inferenciais Phi-4, treinados com 14 bilhões e 3.8 bilhões de parâmetros.

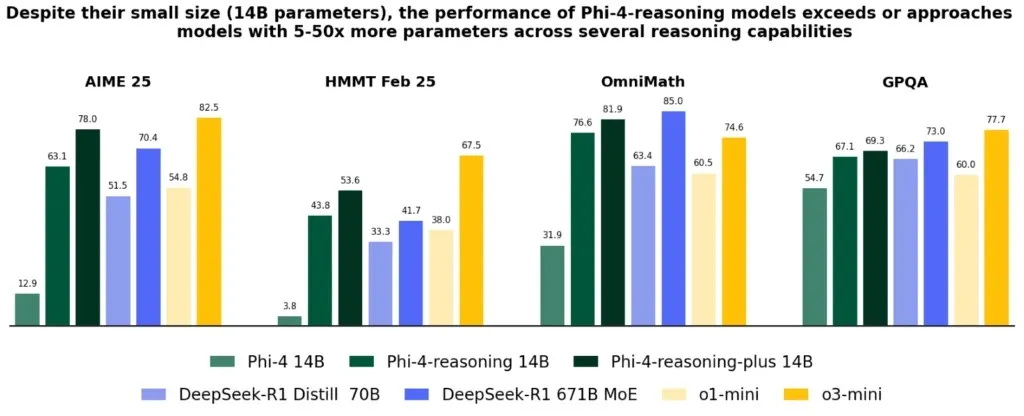

- Apesar do seu tamanho pequeno, os modelos de inferência Phi-4 competem com modelos muito maiores, como o DeepSeek R1 e o o3-mini.

- A Microsoft diz que os modelos de inferência Phi-4 podem ser executados em PCs com Windows Copilot+, graças ao seu pequeno tamanho.

A Microsoft lançou três novos modelos de IA dedutiva, incluindo Phi-4-reasoning, Phi-4-reasoning-plus e Phi-4-mini-reasoning. Esses são pequenos modelos de linguagem, projetados para dispositivos terminais, como computadores Windows e dispositivos móveis. O modelo de IA de raciocínio Phi-4 é treinado com 14 bilhões de parâmetros e pode executar tarefas de inferência complexas.

O modelo Phi-4-raciocínio-plus utiliza o mesmo modelo básico, mas utiliza um cálculo de tempo de inferência adicional, aproximadamente 1.5 vez o número de tokens em comparação com o Phi-4-raciocínio, para proporcionar maior precisão. Apesar do tamanho reduzido, os modelos Phi-4-raciocínio são competitivos com modelos maiores, como DeepSeek R1 671B e o3-mini.

No padrão GPQA, o modelo Phi-4-raciocínio-mais-14B atinge uma pontuação de 69.3%, enquanto o o3-mini 77.7%. Em seguida, no teste AIME 2025, o Phi-4-reasoning-plus-14B obteve 78%, e o o3-mini obteve 82.5%. Ele continua mostrando que o modelo pequeno da Microsoft está muito próximo dos principais modelos de inferência, que são muito maiores em tamanho.

A Microsoft diz que os modelos de inferência Phi-4 foram treinados por meio de ajuste fino supervisionado.Em demonstrações de inferência cuidadosamente selecionadas do OpenAI o3-mini. Além disso, a Microsoft escreve: “O modelo demonstra que a formatação precisa de dados e conjuntos de dados sintéticos de alta qualidade permitem que modelos menores compitam com modelos maiores.. "

Além disso, o modelo menor Phi-4-mini-raciocínio, treinado com apenas 3.8 bilhões de parâmetros, supera muitos modelos 7B e 8B. Em benchmarks como AIME 24, MATH 500 e GPQA Diamond, o modelo Phi-4-mini-reasoning-3.8B oferece resultados competitivos, chegando perto de igualar o o1-mini. Foi concluído "AjustarModelo Phi-4-miniUsando com precisão dados sintéticos gerados pelo modelo Deepseek-R1. "

Os modelos Phi da Microsoft já são usados nativamente em computadores Windows. Copiloto+ PCsEle se beneficia da unidade de processamento neural integrada. Será interessante ver como os modelos de inferência Phi-4 melhoram o desempenho da IA no dispositivo.

Comentários estão fechados.