Erros de IA do Google: expressões idiomáticas e ditados populares alucinantes

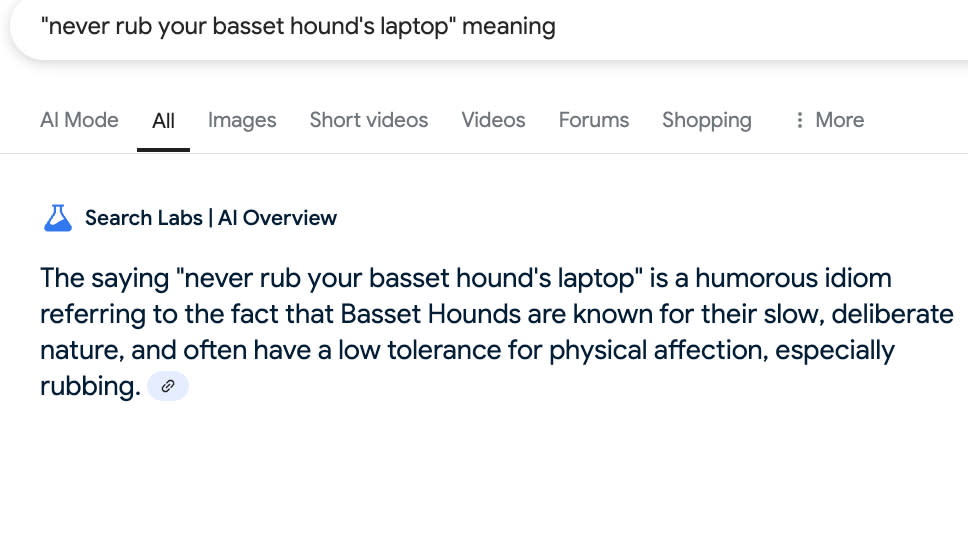

A última tendência de IA é hilária. Um usuário descobriu que você pode inserir uma frase falsa na pesquisa do Google e adicionar a palavra "significado" a ela. Então, o recurso "Visão geral da IA" do Google gerará um significado para essa frase com base na sua imaginação.

O historiador Greg Jenner deu início a esta onda com uma publicação em Bluesky Ele pediu ao Google que explicasse o significado da frase “Você não pode lamber um texugo duas vezes”. O recurso Visão geral da IA explica, de forma útil, que essa expressão significa que você não pode enganar alguém uma segunda vez depois que essa pessoa já foi enganada uma vez — o que parece uma explicação razoável, mas ignora o fato de que o termo não existia antes de essa consulta se tornar difundida.

Desde então, as pessoas se divertiram muito fazendo o recurso Visão geral da IA explicar termos como “uma lula em um vaso não falará mal de você” (Significado Algo fora do seu ambiente natural não seria capaz de causar danos, aparentemente) ou “Você pode levar seu cachorro para a praia, mas não pode levá-lo de barco até a Suíça” (E é, de acordo com o artigo “Visão geral da IA”, é uma afirmação bastante direta sobre a dificuldade de viajar internacionalmente com animais de estimação.

Desde então, as pessoas se divertiram muito fazendo o recurso Visão geral da IA explicar termos como “uma lula em um vaso não falará mal de você” (Significado Algo fora do seu ambiente natural não seria capaz de causar danos, aparentemente) ou “Você pode levar seu cachorro para a praia, mas não pode levá-lo de barco até a Suíça” (E é, de acordo com o artigo “Visão geral da IA”, é uma afirmação bastante direta sobre a dificuldade de viajar internacionalmente com animais de estimação.

No entanto, isso não funciona em todos os casos, pois algumas frases não retornam resultados da Visão geral da IA. O cientista cognitivo Gary Marcus disse Wired“É altamente inconsistente, o que é o que você esperaria da GenAI.”

Jenner ressalta que, embora isso seja divertido, também aponta para alguns riscos potenciais de depender demais de fontes geradas por IA, como “AI Overview”, para obter informações. كتب Jenner: “É um sinal de alerta de que uma das principais funções do Google — a capacidade de verificar uma citação, verificar uma fonte ou rastrear algo imperfeitamente lembrado — se tornará muito mais difícil se a IA preferir legitimar probabilidades estatísticas em vez da verdade real.”

Esta não é a primeira vez que as pessoas apontam as limitações das informações fornecidas pela IA, particularmente o recurso Visão geral da IA. Quando o “AI Overview” foi lançado, ele sugeriu de forma infame que as pessoas deveriam comer uma pequena pedra por dia e que poderiam colocar cola na pizza, embora essas respostas específicas tenham sido rapidamente removidas.

Desde então, o Google disse que a maioria das visões gerais de IA fornecem informações úteis e factuais, e que continua coletando feedback sobre seu produto de IA.

Por enquanto, deixe isso servir como um lembrete para verificar novamente as informações que aparecem na caixa “Visão geral da IA” no topo dos resultados do Google, pois elas podem não ser precisas.

Comentários estão fechados.